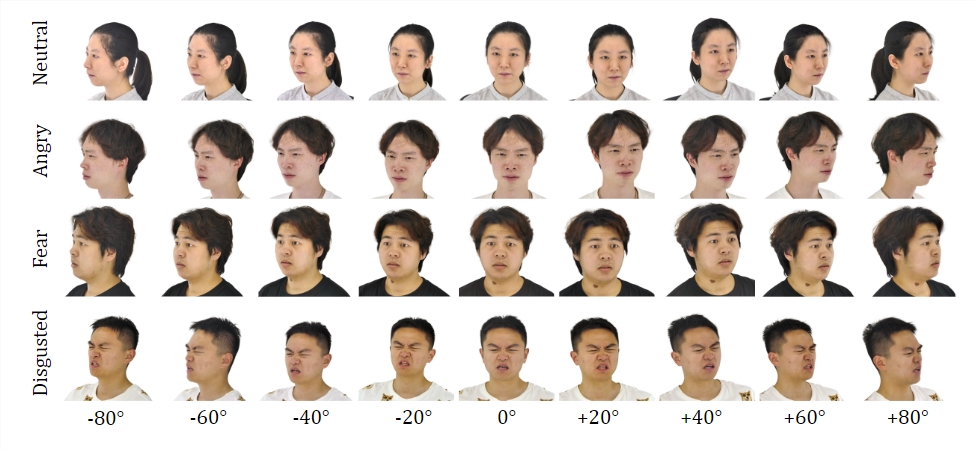

最近、EmoTalk3Dという最先端技術プロジェクトが人工知能分野で大きな注目を集めています。このプロジェクトは、校正済みの多視点ビデオ、感情ラベル、各フレームの3Dジオメトリデータを含むEmoTalk3Dデータセットを導入することで、高忠実度で感情豊かな3Dアバターの自由な合成を実現するという画期的な成果を上げました。

EmoTalk3Dプロジェクトの研究チームは、現在の3Dアバター技術が抱える多視点の一貫性と感情表現における課題に着目し、全く新しい合成手法を提案しました。この手法は、唇の同期とレンダリング品質の向上だけでなく、生成されたアバターで感情表現を制御することも可能です。

研究チームは、「音声からジオメトリ、そして外観へ」というマッピングフレームワークを設計しました。このフレームワークは、まず音声特徴から忠実な3Dジオメトリシーケンスを予測し、次にこれらのジオメトリに基づいて、4Dガウス分布で表現された3Dアバターの外観を合成します。この過程で、外観は正規化されたガウス成分と動的なガウス成分に分解され、多視点ビデオからの学習を通じて両者が融合され、自由視点のアバターアニメーションがレンダリングされます。

特筆すべきは、EmoTalk3Dプロジェクトの研究チームが、しわや微妙な表情など、動的な顔のディテールの捉えにくさという以前の手法の課題を克服したことでしょう。実験結果によると、この手法は、高忠実度で感情制御可能な3Dアバターの生成において顕著な優位性を示し、唇の動き生成においても優れたレンダリング品質と安定性を発揮しました。

現在、EmoTalk3Dプロジェクトのコードとデータセットは、指定されたHTTPS URLで公開されており、世界中の研究者や開発者が参照・利用できます。この革新的な技術的ブレークスルーは、3Dアバター分野の発展に新たな活力を吹き込むとともに、将来、仮想現実、拡張現実、映画制作など様々な分野への応用が期待されます。