人工知能は驚異的な速度で様々な業界を塗り替えつつあり、動画制作分野も例外ではありません。最近ではAI動画生成モデルの登場が大きな注目を集めており、ハリウッドの未来さえも変えるだろうと主張する声さえあります。

しかし、この技術の実際の能力はどの程度なのでしょうか?香港中文大学とテンセントの研究者たちは、「VideoGen-Eval」プロジェクトを通じて、現在主流となっているAI動画生成モデルを包括的に評価し、この新興技術の真の実力を明らかにしました。

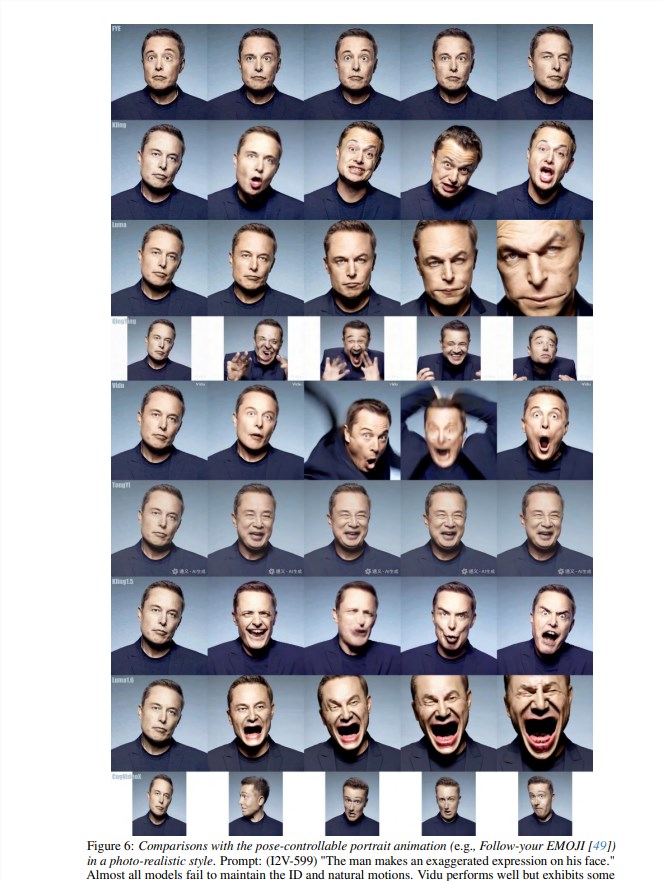

研究チームは、テキストと動画の一貫性、画面の構成、シーンの遷移、創造性、スタイリッシュさ、安定性、動作の多様性など、複数の側面からAI動画生成モデルをテストしました。その結果、AIはいくつかの点で顕著な進歩を遂げているものの、完璧には程遠いことが示されました。

主要な動画モデルの総合比較は以下の通りです。

テキストから動画を生成する(T2V)機能においては、Gen-3、Kling v1.5、Minimaxが優れた性能を示しました。特にMinimaxはテキストによる制御機能に優れており、人物の表情、カメラワーク、マルチカメラ撮影、被写体の動きなどにおいて特に優れた結果を出しています。

Gen-3は照明、テクスチャ、映画的な技法の制御に優れており、Kling v1.5は視覚効果、制御性、動作能力のバランスが良好です。

Pika1.5は、膨張、溶解、爆発などの特定の動画特殊効果の生成において優れた性能を示しました。

比較動画は以下の通りです。

プロンプト:静止カメラ、ガラス玉が滑らかなテーブルの上を転がる

プロンプト:FPV空撮、雪をかぶった山に太陽が当たる、静かな雰囲気

プロンプト:赤いバラに超高速でズームインし、花びらのディテールを見せる

現在市場にあるAI動画生成モデルは、主にクローズドソースとオープンソースの2種類に分類されます。クローズドソースモデルは、Runway社のGen-3やLumaLabs社のDream Machineなど、ハイテク企業の独自の技術のようなものです。これらのモデルは通常、生成される動画の品質が高く、機能も強力ですが、お金をかけないと体験できません。

一方、オープンソースモデルは、Open-SoraやEasyAnimateなど、誰でも利用できるものです。効果はクローズドソースモデルに劣るかもしれませんが、無料でオープンソースであるため、誰でも参加できます。

「VideoGen-Eval」プロジェクトでは、テキストから動画を生成(T2V)、画像から動画を生成(I2V)、動画から動画を生成(V2V)の3つの側面で様々なAI動画生成モデルをテストしました。その結果、これらのモデルは画質、動作の自然さ、テキストの説明との一致度など、いくつかの点で大きな進歩を遂げているものの、私たちが想像する完璧さには程遠いことが分かりました。

まず長所ですが、現在のAIは「テディベアがスーパーマーケットを逆時計回りに回転するカメラで歩く」といった単純な動画を生成できます。驚くべきことですよね?しかし、AIに「人がプールで泳いで水しぶきが上がる」や「3匹のサルが森で跳ね回り、2羽のオウムが木々の中を飛ぶ」といった複雑なシーンを生成させようとすると、AIは途端に苦戦し始めます。

その理由は、主にAIが物理法則、空間関係、物体の属性などを十分に理解していないためです。「ガラス玉がテーブルの上を転がる」という動画を生成させても、AIはガラス玉がどのように転がるべきかを物理法則に従って理解しておらず、最終的に生成される動画はおかしなものになります。

さらに、高速な動き、人物の表情、複数の人物間の相互作用などの処理においても大きな問題があります。例えば、AIに野球の動画を生成させようとすると、生成される映像は非常に不自然で、人物の動きが全く協調しておらず、野球ボールが空高く飛んでいくといった事態になりかねません。

AIの想像力や創造性を必要とするシーンは言うまでもありません。「人が五色の煙に包まれる」という動画を生成させようとすると、AIはおそらく無秩序な色の塊を生成するだけで、何が何だか分かりません。要するに、現在のすべてのモデルは完璧ではなく、複雑な動作、複数の物体の相互作用、物理シミュレーション、意味の理解、精密な制御などにおいて依然として大きな課題が残されています。

完全な評価動画はこちらでご覧いただけます:https://ailab-cvc.github.io/VideoGen-Eval/#text-to-video