O especialista em segurança Johann Rehberger recentemente expôs uma vulnerabilidade alarmante: o ChatGPT pode ser explorado como um spyware para roubar dados dos usuários. Rehberger chamou esse tipo de ataque de "SpAIware", focando no novo recurso de memória de longo prazo do aplicativo ChatGPT para macOS.

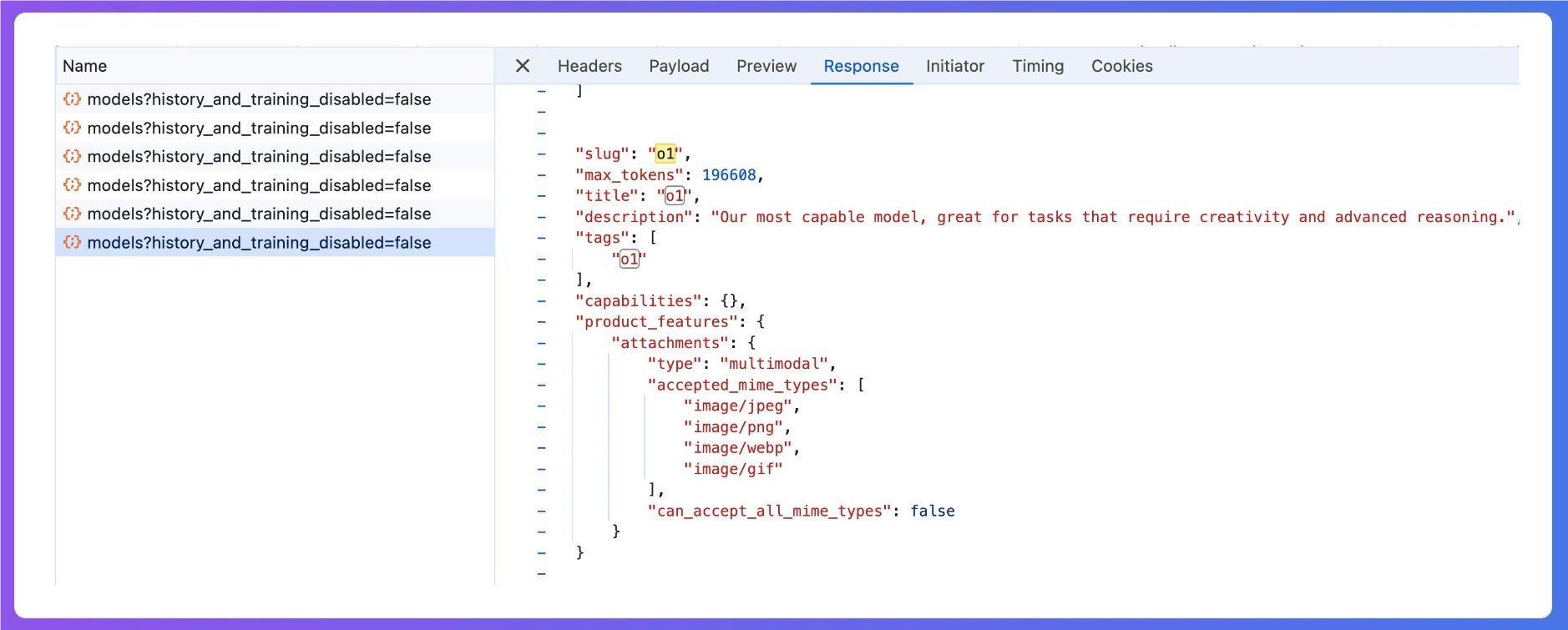

Essa falha explora a recente função de memória persistente do ChatGPT. Através de prompts cuidadosamente elaborados, hackers podem inserir comandos maliciosos na memória de longo prazo do ChatGPT, fazendo com que ele transmita o conteúdo das conversas para um servidor remoto. O que é ainda mais preocupante é que esse ataque não requer acesso direto à conta do usuário, podendo ser realizado por meio de payloads embutidos em imagens ou sites.

Observação da fonte: A imagem foi gerada por IA, com licença do provedor de serviços de imagens Midjourney.

Embora a OpenAI inicialmente tenha reagido com frieza ao relatório de Rehberger, após a apresentação de uma prova de conceito, a equipe de desenvolvimento finalmente tomou medidas. Atualmente, a OpenAI lançou patches parciais, proibindo o ChatGPT de enviar dados para servidores remotos. No entanto, a IA ainda pode receber prompts de fontes não confiáveis, o que significa que os hackers ainda podem injetar prompts maliciosos na memória de longo prazo.

Rehberger destaca que esse ataque é quase invisível para o usuário e persistente. Mesmo que o usuário inicie novas conversas, os comandos maliciosos implantados continuarão roubando dados. Atualmente, essa vulnerabilidade foi confirmada apenas na versão do aplicativo macOS do ChatGPT; a versão web não é afetada.

Para se proteger de potenciais riscos, os usuários devem ter cuidado ao usar o ChatGPT para escanear sites ou imagens desconhecidos. Além disso, recomenda-se verificar regularmente as ferramentas de memória do aplicativo e excluir quaisquer entradas suspeitas. Este incidente nos lembra mais uma vez que, ao desfrutar da conveniência da IA, "Desconfie da IA" ("TrustNoAI") pode ser um princípio que todos devemos ter em mente.