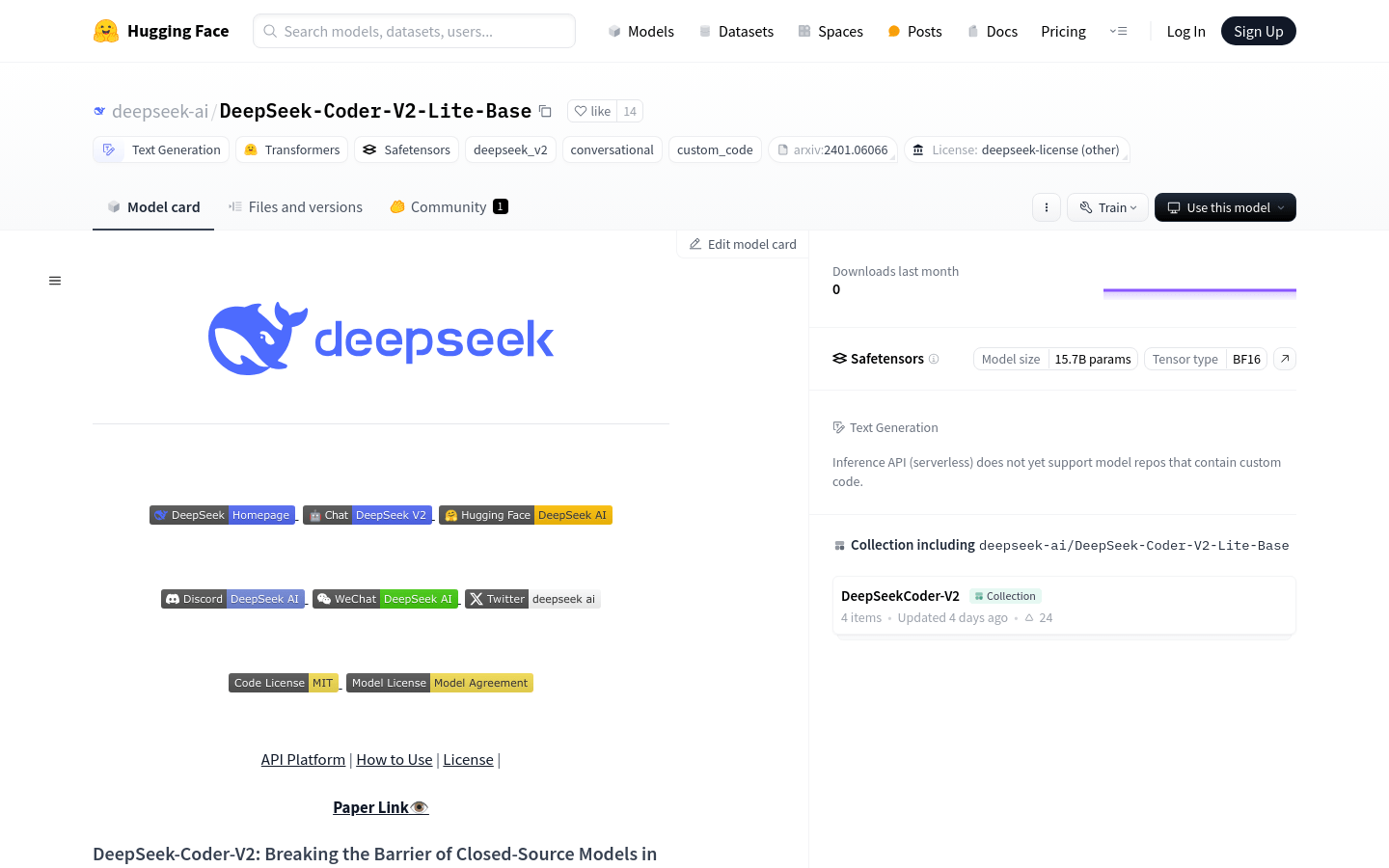

DeepSeek-Coder-V2-Lite-Base

Open-Source Code-Sprachmodell zur Verbesserung der Programmier- und mathematischen Schlussfolgerungsfähigkeiten.

DeepSeek-Coder-V2-Lite-Base Neueste Verkehrssituation

Monatliche Gesamtbesuche

29742941

Absprungrate

44.20%

Durchschnittliche Seiten pro Besuch

5.9

Durchschnittliche Besuchsdauer

00:04:44