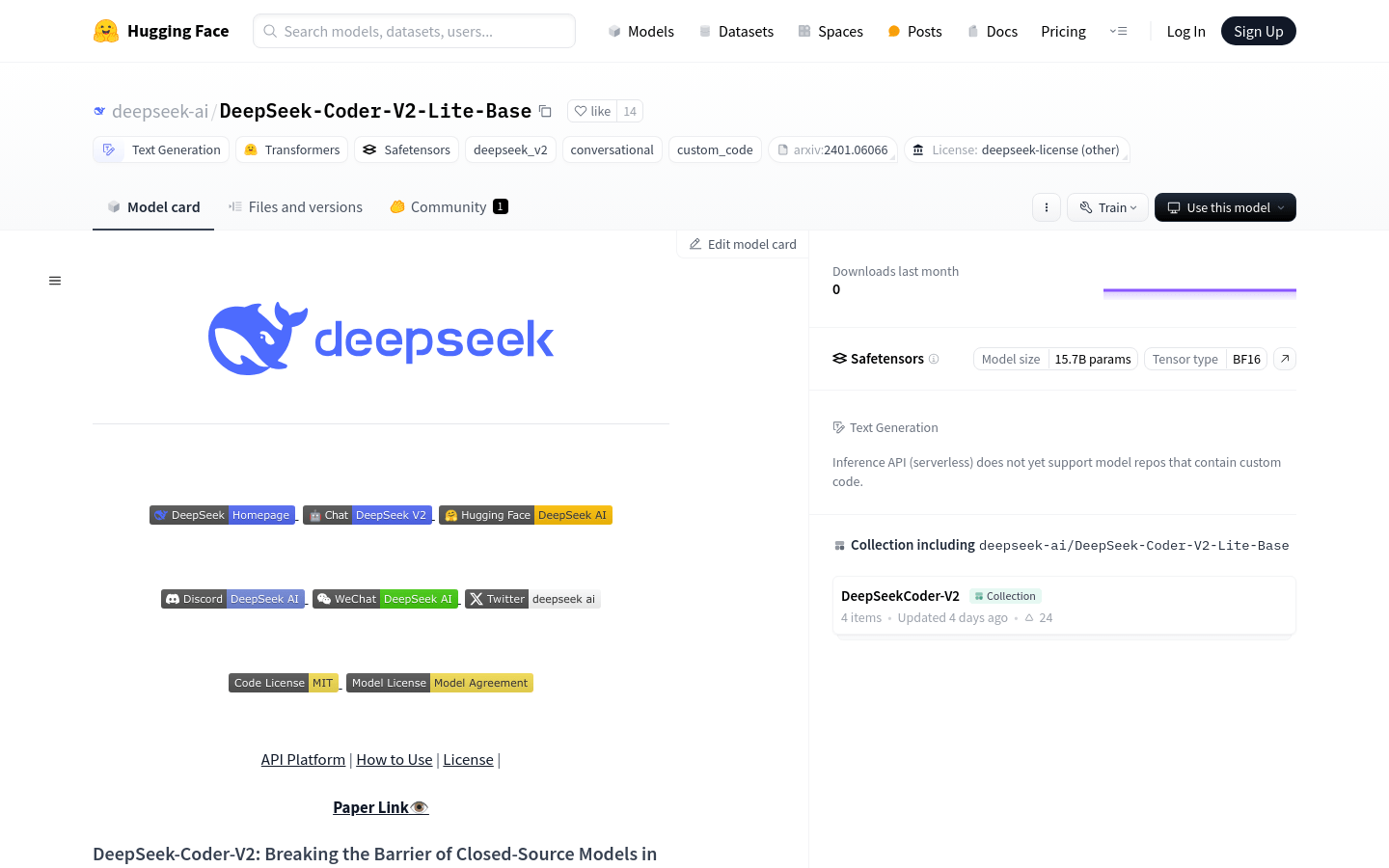

DeepSeek-Coder-V2-Lite-Base

यह एक ओपन सोर्स कोड भाषा मॉडल है जो प्रोग्रामिंग और गणितीय तर्क क्षमता को बेहतर बनाता है।

DeepSeek-Coder-V2-Lite-Base नवीनतम ट्रैफ़िक स्थिति

मासिक कुल विज़िट

29742941

बाउंस दर

44.20%

प्रति विज़िट औसत पृष्ठ

5.9

औसत विज़िट अवधि

00:04:44