法国独立非盈利AI研究实验室 Kyutai 发布了一款语音助理 Moshi,这是一款革命性的实时本机多模态基础模型。这一创新模型在某些功能上模仿并超越了 OpenAI 在五月推出的 GPT-4o 所展示的一些功能。

产品入口:https://top.aibase.com/tool/moshi-chat

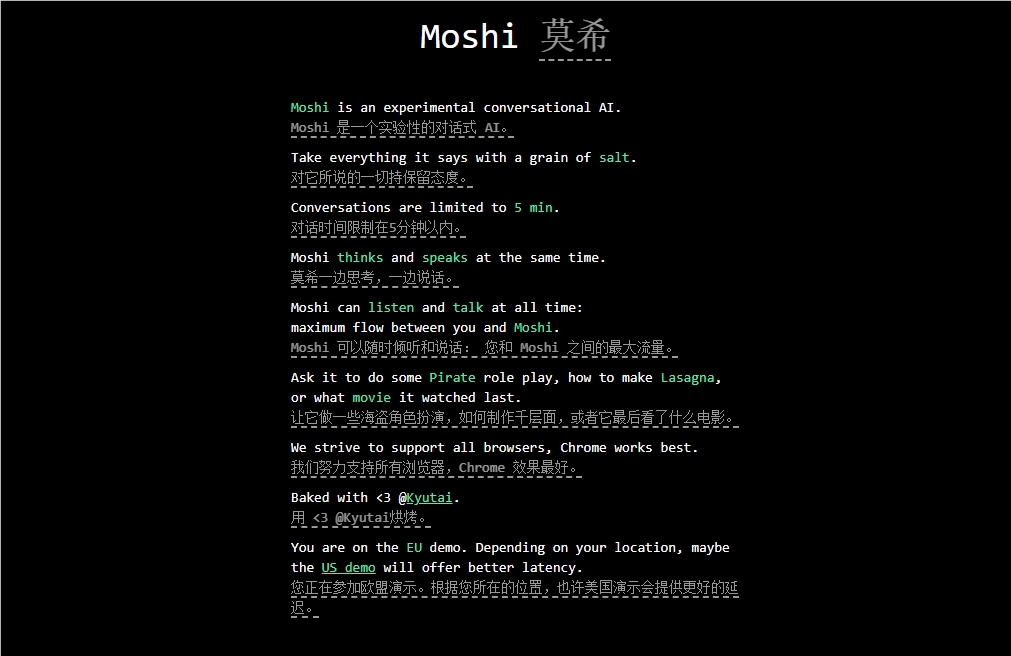

Moshi 旨在理解和表达情感,具备使用不同口音(包括法语)进行对话的能力。它可以同时听和生成音频和语音,并保持文本思维的流畅传达。据了解,Moshi具有多种类似人类的情绪,能够带着70种情绪和风格讲话。

Moshi 的一个突出特点是可以同时处理两个音频流,使其能够同时听和说话。这种实时互动是基于对混合文本和音频进行联合预训练而实现的,利用了 Kyutai 开发的70亿参数语言模型 Helium 的合成文本数据。

Moshi 的微调过程涉及了通过文本转语音(TTS)技术转换的10万个 “口语风格” 合成对话。该模型的声音是通过另一个 TTS 模型生成的合成数据进行训练的,实现了惊人的端到端延迟时间为200毫秒。

值得注意的是,Kyutai 还开发了 Moshi 的一个较小变体,可以在 MacBook 或消费者级 GPU 上运行,使更广泛范围的用户可以使用。

划重点: 🔍 Kyutai 发布了 Moshi,一款实时原生多模态基础 AI 模型。

🔍 Moshi 具备理解和表达情感的功能,支持多种口音。

🔍 该模型经过严格的微调和训练,展示出高效性能和多样化应用潜力。