字节跳动的大模型团队又立了一功,他们的Depth Anything V2模型被苹果公司收入了Core ML模型库。这个成果不仅在技术上取得了突破,更让人瞩目的是,这个项目的领头人,竟然是一位实习生。

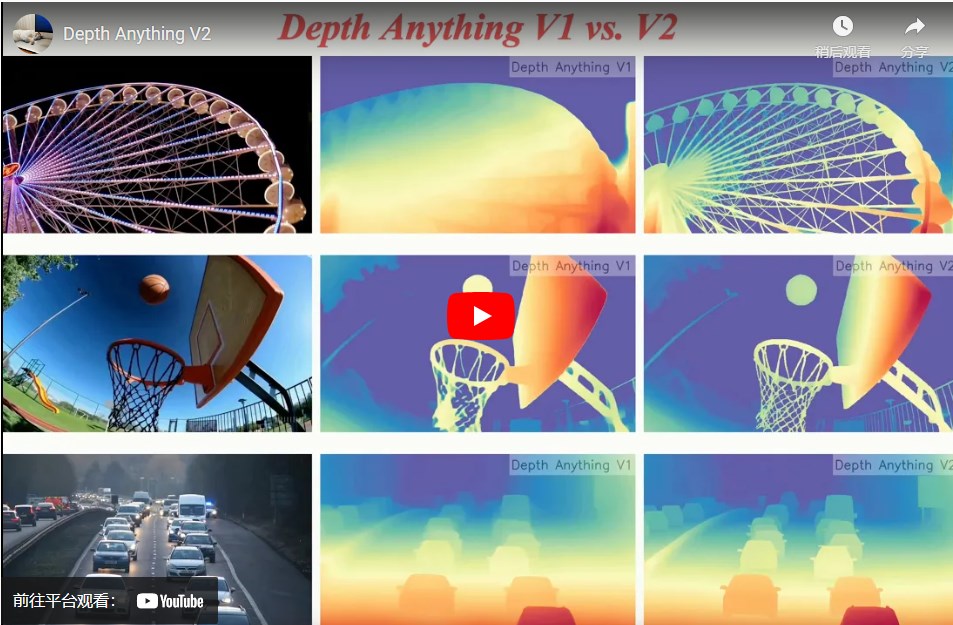

Depth Anything V2是一个单目深度估计模型,它能够从单张图片中估算出场景的深度信息。这个模型从2024年初的V1版本到现在的V2,参数量从25M扩展到了1.3B,应用范围覆盖了视频特效、自动驾驶、3D建模、增强现实等多个领域。

这个模型在GitHub上已经获得了8.7k的Star,V2版本发布不久就有2.3k Star,而V1版本更是收获了6.4k Star。这样的成绩,对于任何一个技术团队来说都是值得骄傲的,更何况这背后的主力是一位实习生。

苹果公司将Depth Anything V2收入Core ML模型库,这是对模型性能和应用前景的高度认可。Core ML作为苹果的机器学习框架,能够让机器学习模型在iOS、MacOS等设备上高效运行,即使在无互联网连接的情况下也能执行复杂的AI任务。

Depth Anything V2的Core ML版本采用了至少25M的模型,经过HuggingFace官方工程优化,在iPhone12Pro Max上的推理速度达到了31.1毫秒。这与FastViT、ResNet50、YOLOv3等其他入选模型一起,涵盖了从自然语言处理到图像识别的多个领域。

在大模型的浪潮中,Scaling Laws的价值被越来越多的人认同。Depth Anything团队选择了构建一个简单但功能强大的基础模型,在单一任务上实现更好的效果。他们认为,利用Scaling Laws解决一些基础问题更具实际价值。深度估计作为计算机视觉领域中的重要任务之一,从图像中推断出场景内物体的距离信息,对于自动驾驶、3D建模、增强现实等应用至关重要。Depth Anything V2不仅在这些领域有广泛的应用前景,还能作为中间件整合进视频平台或剪辑软件中,支持特效制作、视频编辑等功能。Depth Anything项目的一作是团队的实习生,这位新星在Mentor的指导下,从项目设想到论文撰写,不到一年时间就完成了大部分工作。公司和团队提供了自由的研究氛围和充分的支持,鼓励实习生深入研究更难、更本质的问题。

这位实习生的成长和Depth Anything V2的成功,不仅展现了个人的努力和才华,也体现了字节跳动在视觉生成及大模型相关领域的深入探索和人才培养。

项目地址:https://top.aibase.com/tool/depth-anything-v2