在人工智能领域,DeepSeek 团队于近日发布了最新研究成果,推出了一种名为 NSA(Native Sparse Attention)的创新稀疏注意力机制。这项技术的核心目标是提升长上下文训练和推理的速度,特别是针对现代硬件进行了优化,使得训练和推理的效率大幅提升。

NSA 技术的推出,为人工智能模型的训练带来了显著的变化。首先,它通过一系列针对现代计算硬件特性的设计优化,显著提升了推理速度,并有效降低了预训练的成本。更重要的是,在提升速度和降低成本的同时,NSA 仍然保持了高水平的模型性能,确保了模型在多种任务中的表现不受影响。

DeepSeek 团队在其研究中采用了一种分层的稀疏策略,将注意力机制划分为三个分支:压缩、选择和滑动窗口。这种设计使得模型能够同时捕捉全局上下文和局部细节,从而提高了模型对长文本的处理能力。此外,NSA 在内存访问和计算调度方面的优化,使得长上下文训练的计算延迟和资源消耗得以大幅降低。

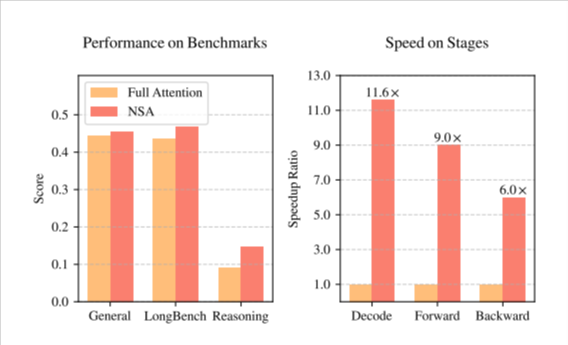

在一系列通用基准测试中,NSA 展示了其优异的性能。特别是在长上下文任务和基于指令的推理上,NSA 的表现甚至与完全注意力模型相当,部分情况下更胜一筹。这一技术的发布,标志着 AI 训练和推理技术的又一次飞跃,将为未来的人工智能发展带来新的动力。

NSA 论文(https://arxiv.org/pdf/2502.11089v1)。

划重点:

🌟 NSA 技术的推出显著提升了长上下文训练和推理的速度,并降低了预训练成本。

🛠️ 采用分层稀疏策略,将注意力机制分为压缩、选择和滑动窗口,增强了模型对长文本的处理能力。

📈 在多项基准测试中,NSA 表现优异,部分情况下超过了传统的完全注意力模型。