苹果在为开发者提供尖端设备端 AI 功能方面取得了重大进展。这家科技巨头最近在领先的 AI 模型和代码共享社区平台 Hugging Face 上发布了20个新的 Core ML 模型和4个数据集。此举凸显了苹果致力于推动 AI 发展,同时优先考虑用户隐私和效率。

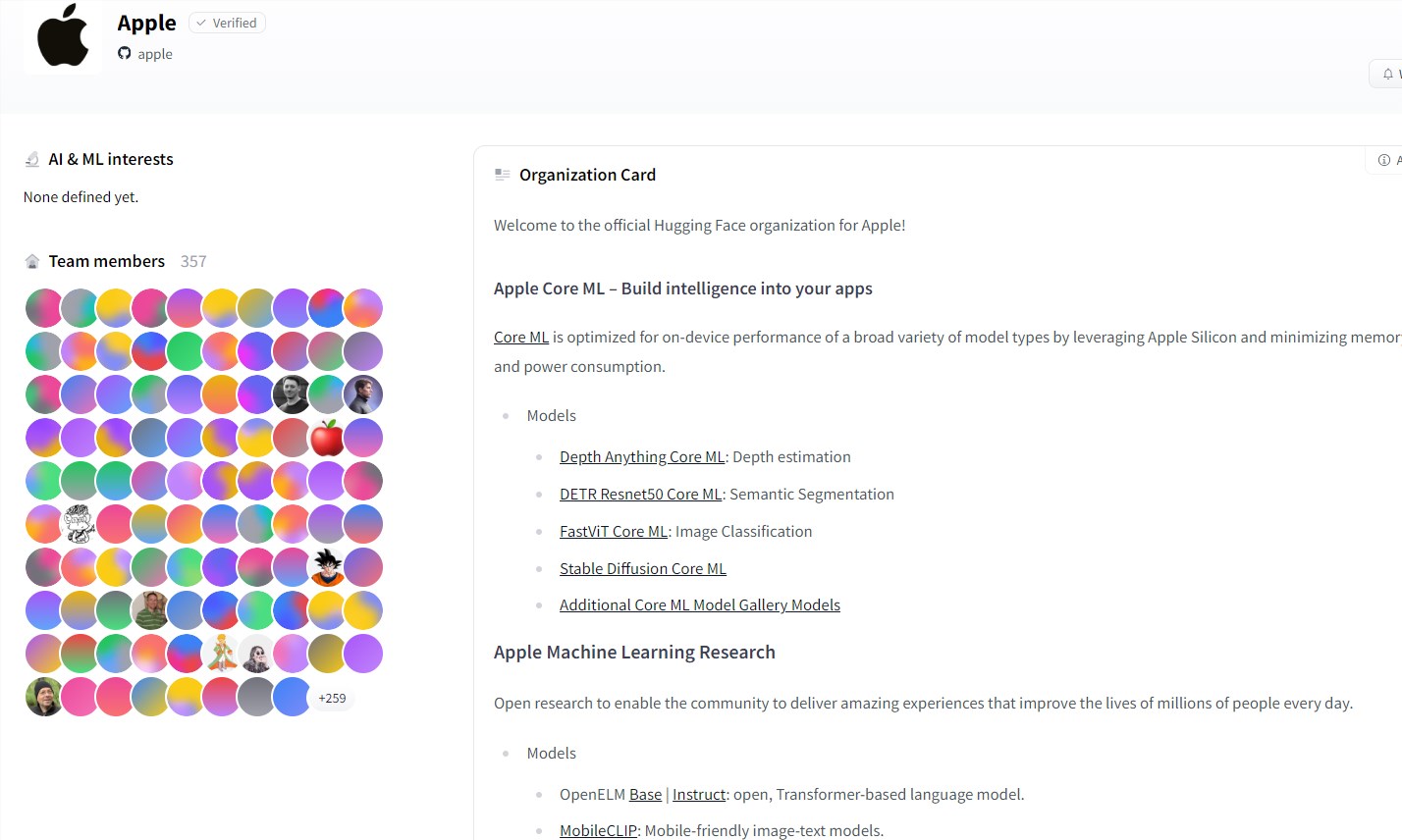

网址:https://huggingface.co/apple

Hugging Face 的联合创始人兼 CEO 克莱门特・德朗格在强调了这一更新的重要性。德朗格表示:“苹果通过将许多模型上传到他们的 Hugging Face 存储库并结合他们的 Core ML 框架进行了重大更新。这次更新包括了很多着眼于文本和图像的令人振奋的新模型,比如图像分类或深度分割。想象一下,一个可以轻松将照片中不需要的背景去除或立即识别您面前物体并以外语提供名称的应用。”

新发布的 Core ML 模型涵盖了广泛的应用,包括用于图像分类的FastViT 、用于单目深度估计的DepthAnything和用于语义分割的DETR。这些模型经过优化,可以独家在用户设备上运行,无需网络连接。这种方法不仅提升了应用程序的性能,还确保用户数据的安全和隐私。

德朗格强调了设备 AI 的重要性,他表示:“Core ML 模型严格在用户设备上运行,无需网络连接。这使得您的应用程序速度极快,同时确保用户数据保持私密。”

在 Hugging Face 平台上发布这些模型和数据集证明了苹果与这一人工智能社区平台日益紧密的合作关系。近几个月来,苹果一直在积极与 Hugging Face 合作,支持各种倡议,如 MLX 社区和将开源 AI 整合到 Apple Intelligence 功能中。

行业专家认为,苹果专注于设备 AI 与将计算能力从云端转移到边缘设备的更广泛趋势是一致的。通过利用 Apple Silicon 的能力,最小化内存占用和功耗,Core ML 使开发者能够创建智能应用,提供无缝的用户体验,而不会影响隐私或性能。