近年、研究者らはShareGPT4Videoシリーズを発表しました。これは、詳細で綿密な字幕によって、大規模ビデオ言語モデル(LVLMs)のビデオ理解と、テキストからビデオへのモデル(T2VMs)のビデオ生成を促進することを目的としています。

ShareGPT4Videoには以下が含まれます。

1)ShareGPT4Video:GPT4Vによって注釈された、長さやソースが異なる40,000本のビデオの緻密な字幕。綿密に設計されたデータフィルタリングと注釈戦略によって開発されました。

2)ShareCaptioner-Video:任意のビデオに適用可能な、効率的で強力なビデオ字幕生成モデル。4,800,000本の高品質で美しいビデオに注釈を付けました。

3)ShareGPT4Video-8B:シンプルながらも優れたLVLMで、3つの高度なビデオベンチマークテストで最先端の性能を達成しました。

拡張性に欠け、コストのかかる人間の注釈者以外に、GPT4Vを使用して単純なマルチフレームまたはフレーム連結入力戦略でビデオ字幕を生成すると、結果に詳細が不足し、時間的な混乱が生じる可能性があることが研究で判明しました。研究チームは、高品質なビデオ字幕戦略を設計する上での課題を以下の3点に絞り込みました。

1)フレーム間の正確な時間変化を理解する。

2)フレーム内の詳細な内容を記述する。

3)任意の長さのビデオに対して、フレーム数の拡張性を確保する。

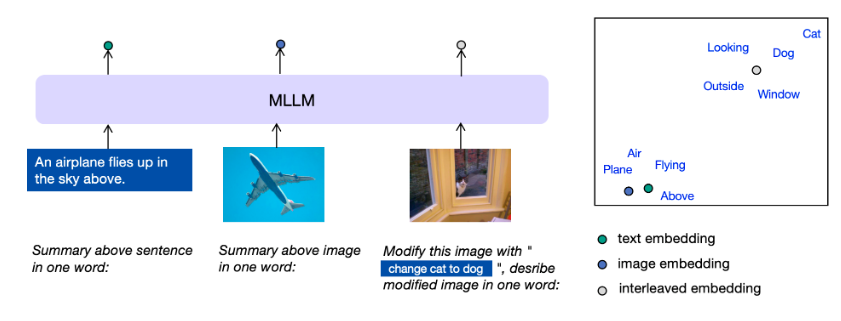

そこで、研究者らは、任意の解像度、アスペクト比、長さのビデオ字幕を生成する上で安定性、拡張性、効率性に優れた、差分ビデオ字幕戦略を綿密に設計しました。これに基づいてShareGPT4Videoを構築し、幅広いカテゴリを網羅する40,000本の高品質ビデオを含み、生成された字幕には、豊富な世界知識、オブジェクト属性、カメラの動き、重要なイベントの詳細で正確な時間記述が含まれています。

ShareGPT4Videoに基づいて、さらに優れた字幕生成モデルであるShareCaptioner-Videoを開発しました。これは、任意のビデオの高品質な字幕を効率的に生成できます。これを使用して、美的魅力の高い4,800,000本のビデオに注釈を付け、10秒間のテキストからビデオへの生成タスクでその有効性を検証しました。ShareCaptioner-Videoは、高速字幕、スライド字幕、クリップ要約、高速再字幕という4つの機能を備えた優れたビデオ字幕モデルです。

ビデオ理解において、研究チームはいくつかの最新のLVLMアーキテクチャに対するShareGPT4Videoの有効性を検証し、優れた新しいLVLMであるShareGPT4Video-8Bを発表しました。