Mixture-of-Attention (MoA)

个性化图像生成的注意力混合架构

普通产品图像图像生成个性化

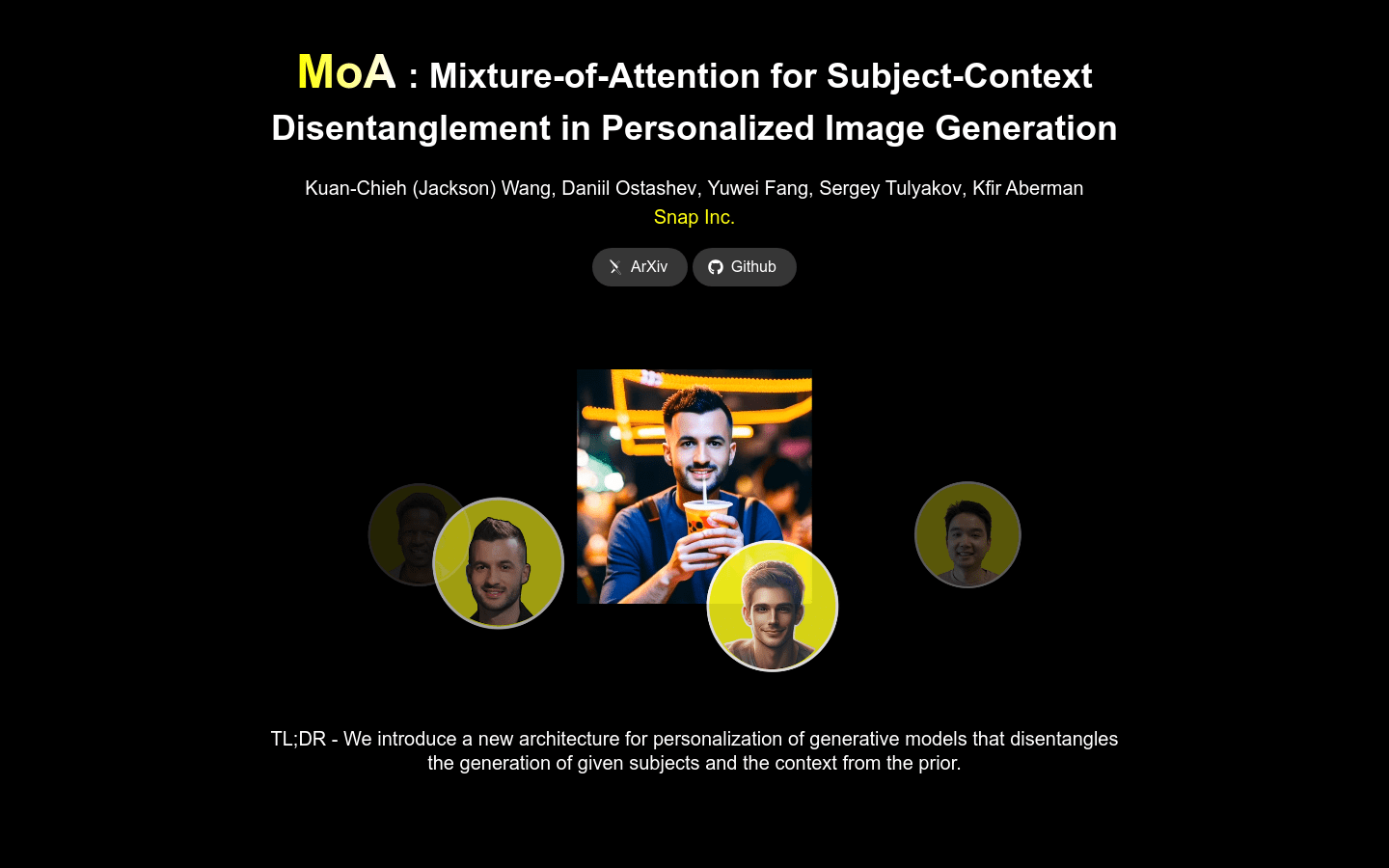

Mixture-of-Attention (MoA) 是一种用于个性化文本到图像扩散模型的新架构,它通过两个注意力路径——个性化分支和非个性化先验分支——来分配生成工作负载。MoA 设计用于保留原始模型的先验,同时通过个性化分支最小干预生成过程,该分支学习将主题嵌入到先验分支生成的布局和上下文中。MoA 通过一种新颖的路由机制管理每层像素在这些分支之间的分布,以优化个性化和通用内容创建的混合。训练完成后,MoA 能够创建高质量、个性化的图像,展示多个主题的组成和互动,与原始模型生成的一样多样化。MoA 增强了模型的先有能力与新增强的个性化干预之间的区别,从而提供了以前无法实现的更解耦的主题上下文控制。

Mixture-of-Attention (MoA) 最新流量情况

月总访问量

40486

跳出率

45.38%

平均页面访问数

1.9

平均访问时长

00:01:25

![FLUX1.1 [pro]](https://pic.chinaz.com/ai/logo/2024/1008/33529.jpg)