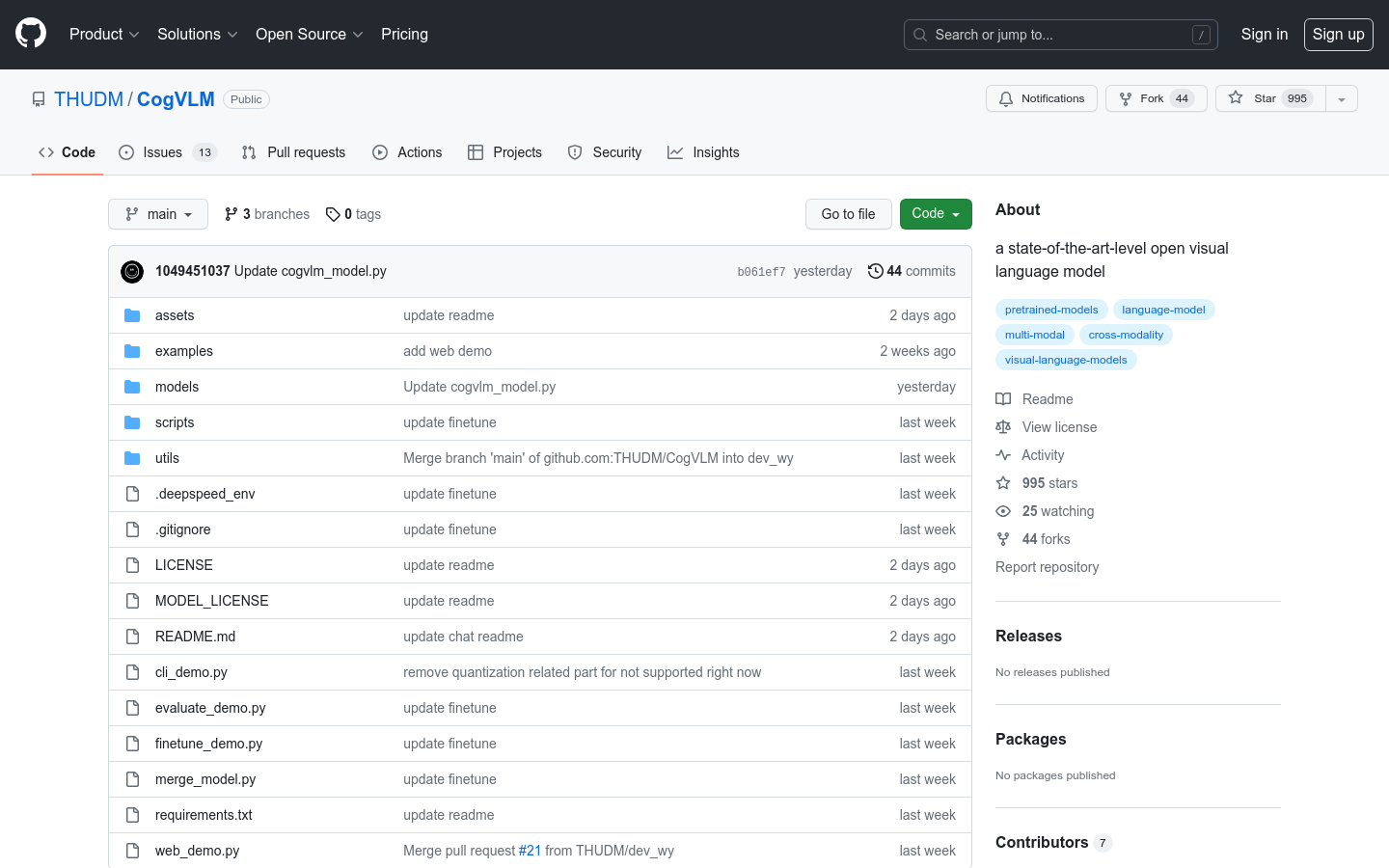

CogVLM

एक शक्तिशाली ओपन-सोर्स दृश्य भाषा मॉडल

सामान्य उत्पादछविदृश्य भाषा मॉडलछवि विवरण

CogVLM एक शक्तिशाली ओपन-सोर्स दृश्य भाषा मॉडल है। CogVLM-17B में 100 अरब दृश्य पैरामीटर और 70 अरब भाषा पैरामीटर हैं। CogVLM-17B ने 10 क्लासिक क्रॉस-मॉडल बेंचमार्क में अत्याधुनिक प्रदर्शन हासिल किया है, जिसमें NoCaps, Flicker30k कैप्शन, RefCOCO, RefCOCO+, RefCOCOg, Visual7W, GQA, ScienceQA, VizWiz VQA और TDIUC शामिल हैं, और VQAv2, OKVQA, TextVQA, COCO कैप्शन आदि में दूसरा स्थान प्राप्त किया है, जो PaLI-X 55B से मेल खाता है या उससे बेहतर है। CogVLM आपसे छवियों पर बातचीत भी कर सकता है।

CogVLM नवीनतम ट्रैफ़िक स्थिति

मासिक कुल विज़िट

474564576

बाउंस दर

36.20%

प्रति विज़िट औसत पृष्ठ

6.1

औसत विज़िट अवधि

00:06:34