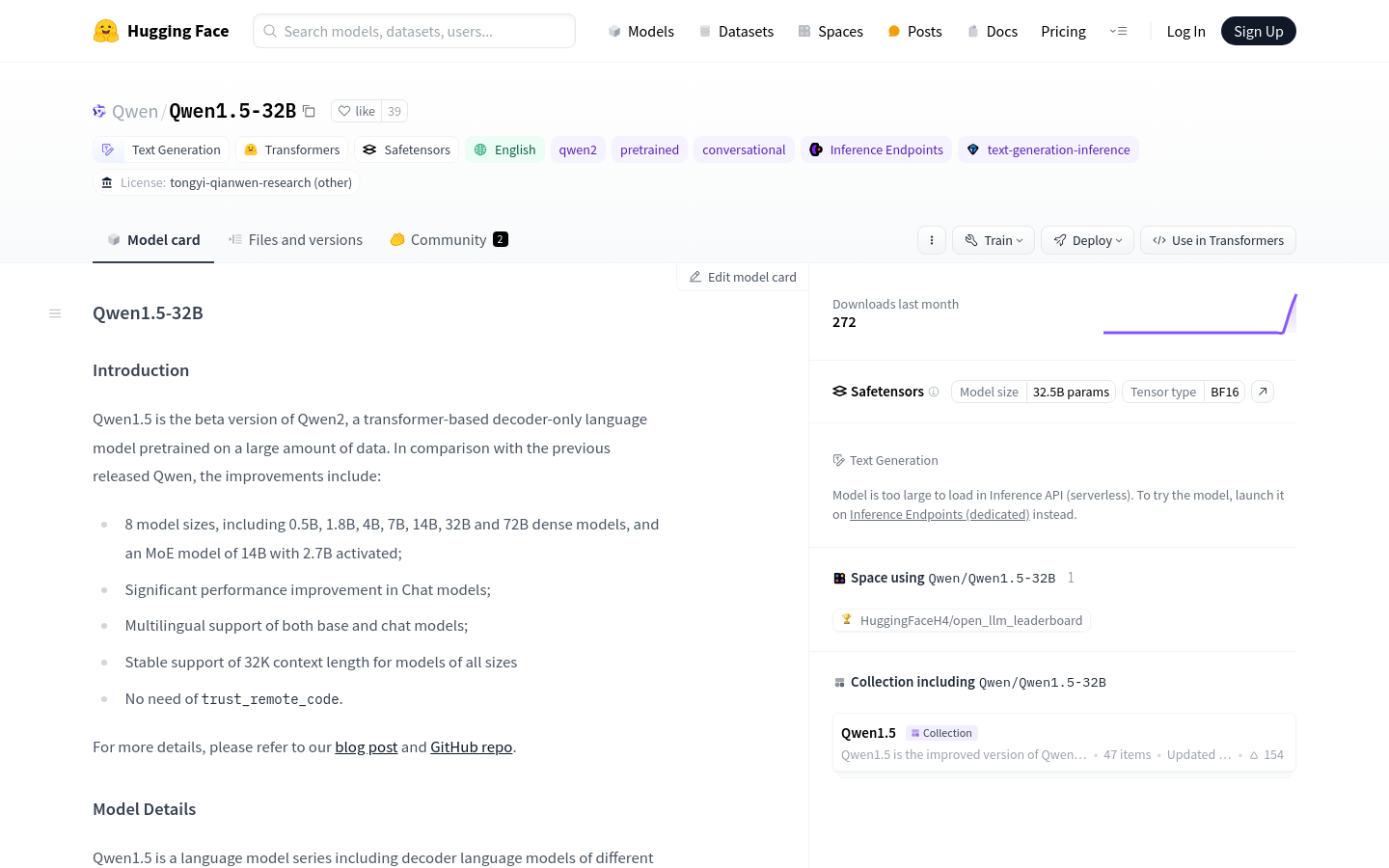

Qwen1.5-32B

Transformerアーキテクチャに基づく事前学習済み言語モデルシリーズ

一般製品生産性事前学習済みモデルTransformer

Qwen1.5は、Transformerアーキテクチャに基づくデコーダ言語モデルシリーズであり、様々な規模のモデルが含まれています。SwiGLU活性化関数、Attention QKVバイアス、グループクエリAttentionなどの特徴を備えています。複数の自然言語とコードをサポートしています。SFT、RLHFなどの後続の学習を行うことを推奨します。価格は無料です。

Qwen1.5-32B 最新のトラフィック状況

月間総訪問数

29742941

直帰率

44.20%

平均ページ/訪問

5.9

平均訪問時間

00:04:44