En el mundo de la inteligencia artificial, los modelos lingüísticos grandes (LLM) se destacan por su excepcional capacidad de procesamiento del lenguaje natural. Sin embargo, la implementación de estos modelos en aplicaciones reales se enfrenta a grandes desafíos, principalmente debido a su alto costo computacional y consumo de memoria durante la etapa de inferencia. Para abordar este problema, los investigadores han estado explorando formas de mejorar la eficiencia de los LLM. Recientemente, un método llamado Q-Sparse ha llamado la atención.

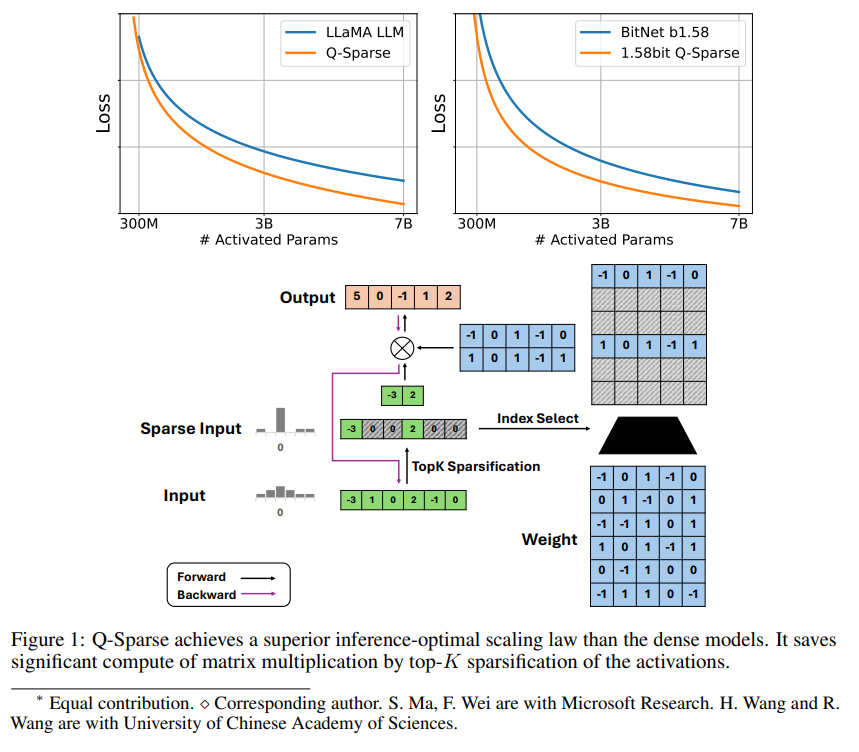

Q-Sparse es un método simple pero efectivo que logra una activación completamente dispersa en los LLM mediante la aplicación de la dispersión top-K en las activaciones y el estimador de paso directo durante el entrenamiento. Esto significa que se puede mejorar significativamente la eficiencia durante la inferencia. Los resultados clave de la investigación incluyen:

Q-Sparse logra una mayor eficiencia de inferencia mientras mantiene resultados comparables a los LLM de referencia.

Se propone una ley de escalado óptima para la inferencia en LLM con activación dispersa.

Q-Sparse es efectivo en diferentes configuraciones, incluyendo el entrenamiento desde cero, el entrenamiento continuo y el ajuste fino de LLM pre-entrenados.

Q-Sparse es aplicable a LLM de precisión completa y de 1 bit (como BitNet b1.58).

Ventajas de la activación dispersa

La dispersión mejora la eficiencia de los LLM de dos maneras: en primer lugar, reduce la cantidad de cálculos en la multiplicación de matrices, ya que los elementos cero no se calculan; en segundo lugar, reduce la cantidad de transferencia de entrada/salida (E/S), que es el principal cuello de botella en la etapa de inferencia de los LLM.

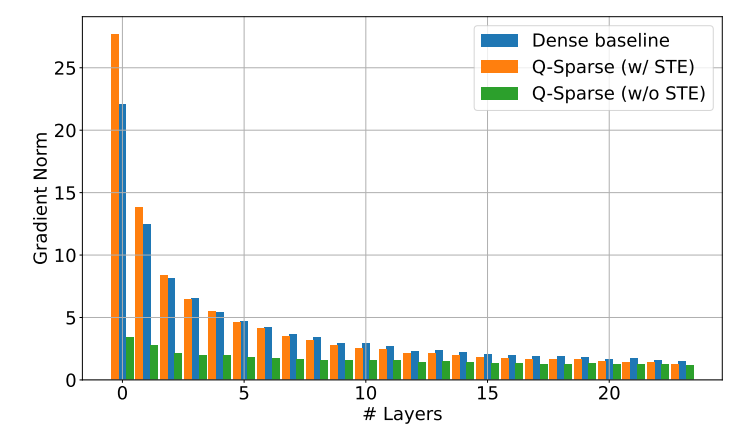

Q-Sparse logra la dispersión completa de la activación aplicando una función de dispersión top-K en cada proyección lineal. Para la retropropagación, se utiliza un estimador de paso directo para calcular el gradiente de la activación. Además, se introduce la función ReLU cuadrada para mejorar aún más la dispersión de la activación.

Verificación experimental

Los investigadores estudiaron la ley de escalado de los LLM con activación dispersa a través de una serie de experimentos de escalado y obtuvieron algunos hallazgos interesantes:

El rendimiento de los modelos con activación dispersa mejora con el aumento del tamaño del modelo y la tasa de dispersión.

Dada una tasa de dispersión S fija, el rendimiento del modelo con activación dispersa presenta una ley de escalado de potencia con el tamaño del modelo N.

Dado un parámetro N fijo, el rendimiento del modelo con activación dispersa presenta una ley de escalado exponencial con la tasa de dispersión S.

Q-Sparse no solo se puede utilizar para el entrenamiento desde cero, sino también para el entrenamiento continuo y el ajuste fino de los LLM pre-entrenados. En las configuraciones de entrenamiento continuo y ajuste fino, los investigadores utilizan la misma arquitectura y proceso de entrenamiento que en el entrenamiento desde cero, la única diferencia es que se utilizan pesos pre-entrenados para inicializar el modelo y se activa la función de dispersión para continuar el entrenamiento.

Los investigadores están explorando el uso de Q-Sparse con LLM de 1 bit (como BitNet b1.58) y modelos de expertos mixtos (MoE) para mejorar aún más la eficiencia de los LLM. Además, también están trabajando para hacer que Q-Sparse sea compatible con el modo por lotes, lo que proporcionará más flexibilidad para el entrenamiento y la inferencia de los LLM.