El Instituto de Inteligencia Artificial de Beijing (BAAI) ha lanzado Infinity-Instruct, un conjunto de datos de ajuste fino con millones de instrucciones, diseñado para mejorar el rendimiento de los modelos de lenguaje en tareas como el diálogo. Recientemente, Infinity Instruct ha completado una nueva iteración, incluyendo el conjunto de datos de instrucciones básicas Infinity-Instruct-7M y el conjunto de datos de instrucciones de diálogo Infinity-Instruct-Gen.

Infinity-Instruct-7M, el conjunto de datos de instrucciones básicas, contiene más de 7,44 millones de datos que abarcan áreas como matemáticas, código y preguntas y respuestas de conocimiento general, con el objetivo de mejorar las capacidades básicas de los modelos preentrenados. Los resultados de las pruebas muestran que los modelos Llama3.1-70B y Mistral-7B-v0.1, ajustados con este conjunto de datos, se acercan en capacidad general a los modelos de diálogo oficiales; incluso Mistral-7B supera a GPT-3.5, mientras que Llama3.1-70B se acerca a GPT-4.

Infinity-Instruct-Gen, el conjunto de datos de instrucciones de diálogo, contiene 1,49 millones de instrucciones complejas sintéticas, con el propósito de mejorar la robustez del modelo en escenarios de diálogo reales. Después de un ajuste fino adicional con este conjunto de datos, el rendimiento del modelo puede superar al de los modelos de diálogo oficiales.

El Instituto de Inteligencia Artificial de Beijing ha probado Infinity-Instruct en los principales rankings de evaluación como MTBench, AlpacaEval2 y Arena-Hard. Los resultados muestran que los modelos ajustados con Infinity-Instruct superan a los modelos oficiales en capacidad de diálogo.

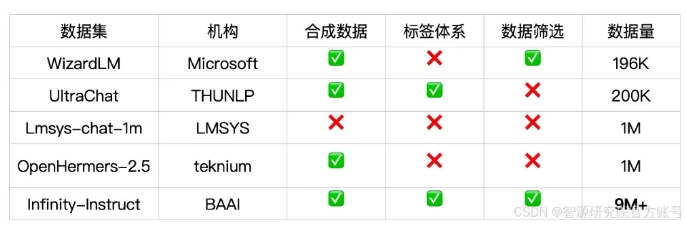

Infinity-Instruct proporciona etiquetas detalladas para cada instrucción, como idioma, tipo de capacidad, tipo de tarea y origen de los datos, lo que facilita a los usuarios la selección de subconjuntos de datos según sus necesidades. El Instituto de Inteligencia Artificial de Beijing ha construido un conjunto de datos de alta calidad mediante la selección de datos y la síntesis de instrucciones para reducir la brecha entre los modelos de diálogo de código abierto y GPT-4.

El proyecto también utiliza el marco de entrenamiento FlagScale para reducir los costos de ajuste fino, y utiliza la eliminación de duplicados MinHash y la recuperación BGE para eliminar muestras repetidas. BAAI planea publicar en el futuro el código completo del proceso de procesamiento de datos y entrenamiento del modelo, y explorar la extensión de la estrategia de datos Infinity-Instruct a las etapas de alineación y preentrenamiento para apoyar las necesidades de datos del ciclo de vida completo de los modelos de lenguaje.

Enlace al conjunto de datos:

https://modelscope.cn/datasets/BAAI/Infinity-Instruct