Meta recientemente lanzó un nuevo benchmark llamado Multi-IF, diseñado para evaluar la capacidad de los modelos de lenguaje grandes (LLM) para seguir instrucciones en conversaciones de múltiples turnos y entornos multilingües. Este benchmark abarca ocho idiomas, incluye 4501 tareas de conversación de tres turnos y se centra en el rendimiento de los modelos actuales en escenarios complejos de múltiples turnos y multilingües.

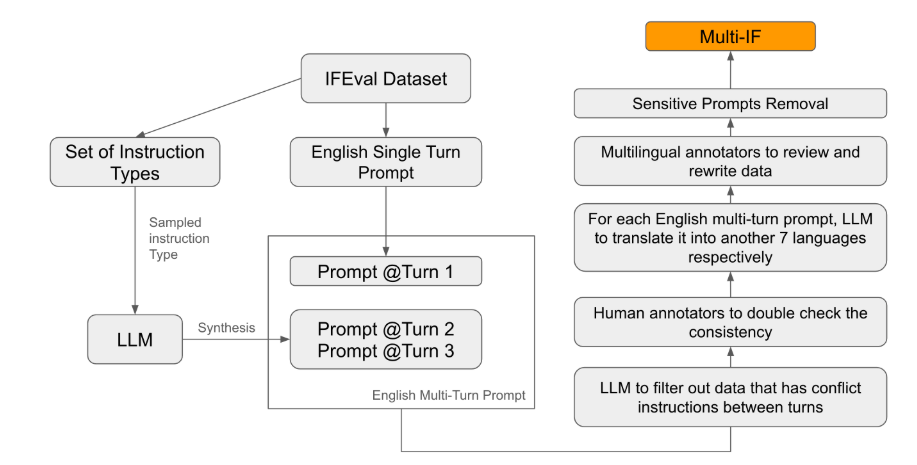

La mayoría de los estándares de evaluación existentes se centran en conversaciones de un solo turno y tareas monolingües, lo que dificulta la reflexión completa del rendimiento de los modelos en aplicaciones reales. El lanzamiento de Multi-IF pretende precisamente llenar este vacío. El equipo de investigación generó escenarios de conversación complejos expandiendo las instrucciones de un solo turno a instrucciones de múltiples turnos, asegurando la coherencia y progresión lógica de cada turno de instrucción. Además, el conjunto de datos admite múltiples idiomas mediante traducción automática y revisión humana.

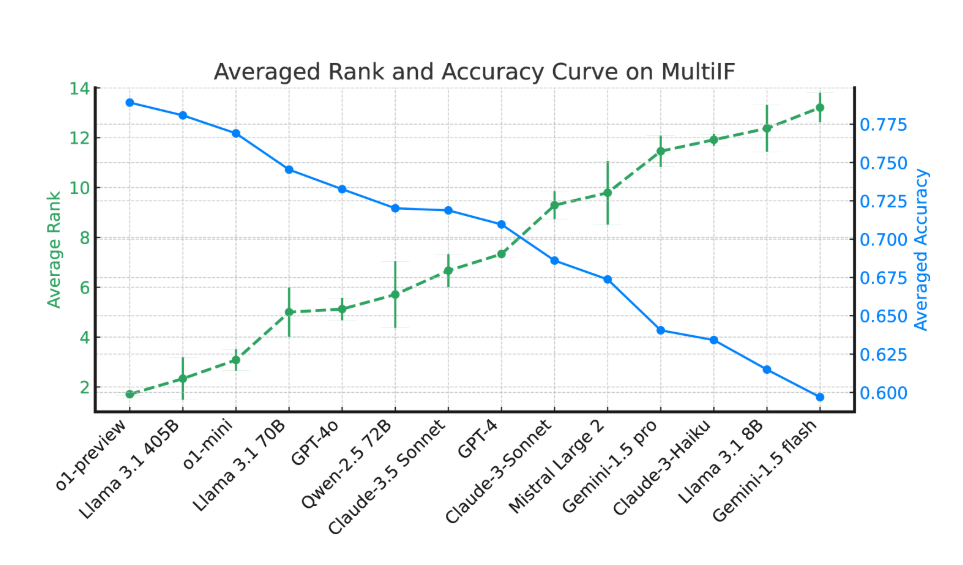

Los resultados experimentales muestran que el rendimiento de la mayoría de los LLM disminuye significativamente en conversaciones de múltiples turnos. Tomemos como ejemplo el modelo o1-preview: su precisión promedio en la primera ronda es del 87,7%, pero en la tercera ronda desciende al 70,7%. En particular, en idiomas con escritura no latina, como el hindi, el ruso y el chino, el rendimiento del modelo es generalmente inferior al del inglés, lo que muestra sus limitaciones en tareas multilingües.

En la evaluación de 14 modelos de lenguaje de vanguardia, o1-preview y Llama3.1405B mostraron el mejor rendimiento, con una precisión promedio del 78,9% y 78,1% respectivamente en instrucciones de tres turnos. Sin embargo, en conversaciones de múltiples turnos, la capacidad de seguimiento de instrucciones de todos los modelos disminuyó en general, lo que refleja los desafíos de los modelos en tareas complejas. El equipo de investigación también introdujo la "tasa de olvido de instrucciones" (IFR) para cuantificar el fenómeno del olvido de instrucciones en conversaciones de múltiples turnos. Los resultados muestran que los modelos de alto rendimiento tienen un mejor desempeño en este aspecto.

El lanzamiento de Multi-IF proporciona a los investigadores un benchmark desafiante que impulsa el desarrollo de LLM en aplicaciones globales y multilingües. El lanzamiento de este benchmark no solo revela las deficiencias de los modelos actuales en tareas de múltiples turnos y multilingües, sino que también proporciona una dirección clara para futuras mejoras.

Artículo: https://arxiv.org/html/2410.15553v2

Puntos clave:

🌍 El benchmark Multi-IF abarca ocho idiomas, incluye 4501 tareas de conversación de tres turnos y evalúa el rendimiento de los LLM en escenarios complejos.

📉 Los experimentos muestran que la precisión de la mayoría de los LLM disminuye significativamente en conversaciones de múltiples turnos, especialmente en idiomas con escritura no latina.

🔍 Los modelos o1-preview y Llama3.1405B muestran el mejor rendimiento, con una precisión promedio del 78,9% y 78,1% respectivamente en instrucciones de tres turnos.