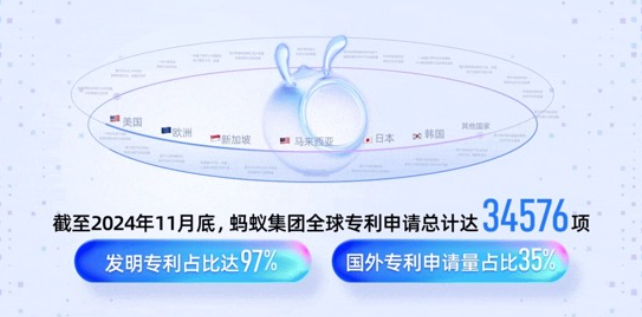

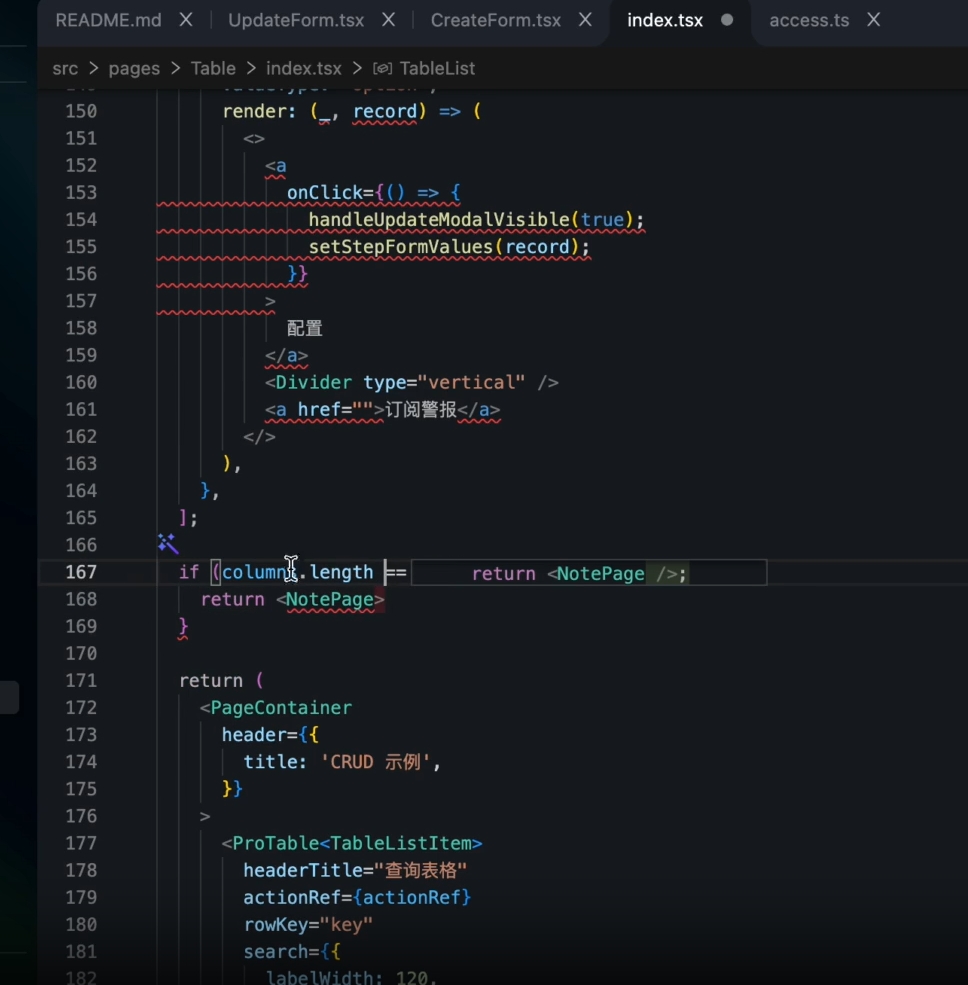

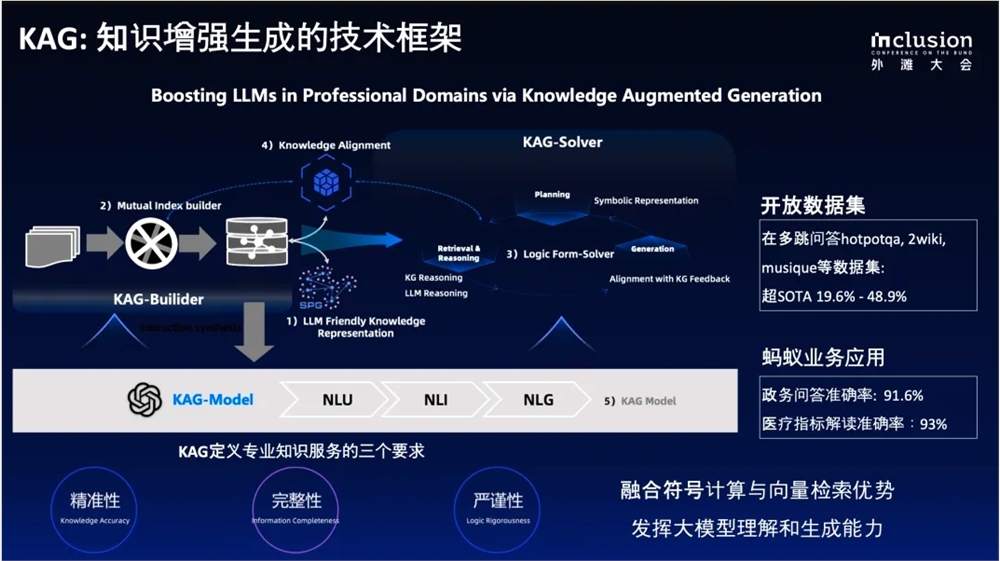

एंटी ग्रुप के तहत CodeFuse कोड मॉडल ने ModelCache बड़े मॉडल के अर्थ कैश को ओपन-सोर्स किया है, जिससे बड़े मॉडल अनुप्रयोगों के इनफेरेंस लागत को कम किया जा सके और उपयोगकर्ता अनुभव को बढ़ाया जा सके। ModelCache की संरचना में adapter, embedding, similarity और data_manager मॉड्यूल शामिल हैं, जो पाठ को अर्थ वेक्टर प्रतिनिधित्व में परिवर्तित कर सकते हैं और वेक्टर की समानता रैंकिंग और मूल्यांकन कर सकते हैं। ModelCache के ऑनलाइन प्रभाव आंकड़े बताते हैं कि कैश हिट होने पर औसत समय में 10 गुना कमी आ सकती है, और गति दर 14.5% तक पहुंच सकती है। भविष्य में, ModelCache प्रदर्शन और सटीकता को अनुकूलित करना जारी रखेगा, ताकि पुनः प्राप्ति समय और सटीकता को बढ़ाया जा सके।

एंट ग्रुप CodeFuse कोड बड़े मॉडल ओपन-सोर्स ModelCache बड़े मॉडल सेमांटिक कैश

站长之家

यह लेख AIbase दैनिक से है

【AI दैनिक】 कॉलम में आपका स्वागत है! यहाँ आर्टिफ़िशियल इंटेलिजेंस की दुनिया का पता लगाने के लिए आपकी दैनिक मार्गदर्शिका है। हर दिन हम आपके लिए AI क्षेत्र की हॉट कंटेंट पेश करते हैं, डेवलपर्स पर ध्यान केंद्रित करते हैं, तकनीकी रुझानों को समझने में आपकी मदद करते हैं और अभिनव AI उत्पाद अनुप्रयोगों को समझते हैं।