हाल ही में, Meta ने छह अनुसंधान निष्कर्षों को चुपचाप जारी किया, जो AI क्षेत्र में नए अनुप्रयोगों और तकनीकी नवाचारों का परिचय देते हैं। इनमें बहु-मोडल मॉडल, पाठ निर्माण संगीत मॉडल, ऑडियो वॉटरमार्किंग तकनीक, डेटा सेट और कई अन्य परियोजनाएँ शामिल हैं। आइए देखें कि ये अनुसंधान निष्कर्ष वास्तव में क्या हैं।

Meta Chameleon (“छिपकली” मॉडल)

पहला, जारी किया गया बहु-मोडल मॉडल “Chameleon” पाठ और छवियों को एक साथ संसाधित कर सकता है, मिश्रित इनपुट और आउटपुट पाठ का समर्थन करता है, जिससे बहु-मोडल डेटा को संभालने के लिए एक नई समाधान प्रदान करता है।

हालांकि वर्तमान में अधिकांश पोस्ट-फ्यूजन मॉडल फैलाव-आधारित अध्ययन का उपयोग करते हैं, Meta Chameleon पाठ और छवियों के लिए टोकनाइजेशन का उपयोग करता है। यह एक अधिक एकीकृत दृष्टिकोण को सक्षम करता है और मॉडल को डिज़ाइन, बनाए रखने और विस्तारित करने में आसान बनाता है।

निम्नलिखित वीडियो उदाहरण: छवि उत्पन्न करने वाले रचनात्मक शीर्षक या पाठ संकेत और छवि का मिश्रण का उपयोग करके एक नया दृश्य बनाना

वर्तमान में, Meta अनुसंधान लाइसेंस के अनुसार Chameleon7B और 34B मॉडल के महत्वपूर्ण घटकों को सार्वजनिक रूप से जारी करेगा। वर्तमान में जारी किए गए मॉडल को सुरक्षा समायोजन के तहत रखा गया है, जो मिश्रित मोड इनपुट और शुद्ध पाठ आउटपुट का समर्थन करता है, जिसका उपयोग अनुसंधान उद्देश्यों के लिए किया जा सकता है। आधिकारिक तौर पर यह स्पष्ट किया गया है कि Chameleon छवि उत्पन्न करने वाला मॉडल जारी नहीं किया जाएगा।

उत्पाद प्रवेश:https://top.aibase.com/tool/meta-chameleon

Multi-Token Prediction (बहु-शब्द भविष्यवाणी)

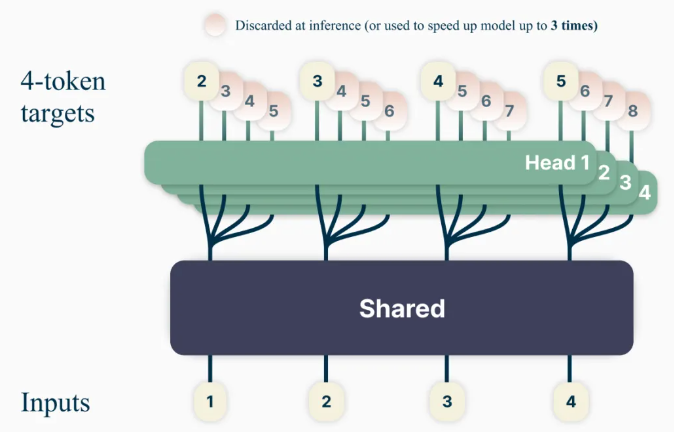

नई भाषा मॉडल प्रशिक्षण विधि “Multi-Token Prediction” का उद्देश्य मॉडल की क्षमता और प्रशिक्षण दक्षता को बढ़ाना है, जो एक बार में कई शब्दों की भविष्यवाणी करने के लिए मॉडल को प्रशिक्षित करती है, जिससे मॉडल की भविष्यवाणी सटीकता में वृद्धि होती है।

इस विधि का उपयोग करके, भाषा मॉडल को एक साथ कई भविष्यवाणियों के लिए प्रशिक्षित किया जा सकता है, बजाय इसके कि पहले हर बार एक शब्द की भविष्यवाणी की जाए। इससे मॉडल की क्षमता और प्रशिक्षण दक्षता में सुधार होता है, साथ ही गति भी बढ़ती है। जिम्मेदार ओपन साइंस के सिद्धांत के तहत, आधिकारिक रूप से गैर-व्यावसायिक/अनुसंधान विशेष लाइसेंस के तहत कोड पूर्णता के लिए पूर्व-प्रशिक्षित मॉडल जारी किया जाएगा।

उत्पाद प्रवेश: https://top.aibase.com/tool/multi-token-prediction

पाठ निर्माण संगीत मॉडल “JASCO”

हालांकि मौजूदा पाठ से संगीत मॉडल (जैसे MusicGen) मुख्य रूप से संगीत उत्पन्न करने के लिए पाठ इनपुट पर निर्भर करते हैं, Meta का नया मॉडल “समय नियंत्रण पाठ से संगीत उत्पन्न करने के लिए मेटा संयुक्त ऑडियो और प्रतीकात्मक शर्त” (JASCO) विभिन्न शर्तों के इनपुट को स्वीकार कर सकता है, जैसे विशिष्ट हार्मोन या ताल, संगीत उत्पादन पर नियंत्रण में सुधार करने के लिए। विशेष रूप से, जानकारी की बाधा परत को समय धुंधलापन के साथ संयोजित किया जा सकता है, ताकि विशेष नियंत्रण से संबंधित जानकारी को निकाला जा सके। यह एक ही पाठ से संगीत उत्पन्न करने वाले मॉडल में प्रतीकात्मक और ऑडियो-आधारित शर्तों को एक साथ लाने की अनुमति देता है।

JASCO उत्पन्न गुणवत्ता के मामले में मूल्यांकन आधार रेखा के बराबर है, जबकि उत्पन्न संगीत पर बेहतर और अधिक लचीला नियंत्रण की अनुमति देता है। आधिकारिक तौर पर अनुसंधान पत्र और उदाहरण पृष्ठ जारी किया जाएगा, इस महीने के अंत में MIT लाइसेंस के तहत AudioCraft भंडार के एक भाग के रूप में निष्पादन कोड जारी किया जाएगा, और CC-BY-NC के तहत पूर्व-प्रशिक्षित मॉडल जारी किया जाएगा।

कोड प्रवेश:https://top.aibase.com/tool/audiocraft

ऑडियो वॉटरमार्किंग तकनीक “AudioSeal”

यह AI द्वारा उत्पन्न आवाज़ों की स्थानीय पहचान के लिए डिज़ाइन की गई पहली ऑडियो वॉटरमार्किंग तकनीक है, जो लंबे ऑडियो क्लिप में AI द्वारा उत्पन्न हिस्सों को सटीक रूप से पहचानने में सक्षम है। AudioSeal ने पारंपरिक ऑडियो वॉटरमार्किंग में सुधार किया है, जो AI द्वारा उत्पन्न सामग्री का पता लगाने पर ध्यान केंद्रित करता है, न कि स्टेग्नोग्राफी पर।

पारंपरिक विधियों की तुलना में, जो जटिल डिकोडिंग एल्गोरिदम पर निर्भर करती हैं, AudioSeal की स्थानीय पहचान विधि तेज और अधिक प्रभावी पहचान की अनुमति देती है। पिछले तरीकों की तुलना में, इस डिज़ाइन ने पहचान गति को 485 गुना बढ़ा दिया है, जिससे यह बड़े पैमाने पर और वास्तविक समय के अनुप्रयोगों के लिए बहुत उपयुक्त है। हमारी विधि ऑडियो वॉटरमार्किंग की मजबूती और अप्रत्यक्षता के मामले में अत्याधुनिक प्रदर्शन हासिल करती है।

AudioSeal व्यावसायिक लाइसेंस के तहत जारी किया गया है।

उत्पाद प्रवेश:https://top.aibase.com/tool/audioseal

PRISM डेटा सेट

इस बीच, Meta ने बाहरी भागीदारों के साथ मिलकर PRISM डेटा सेट भी जारी किया है, जिसमें 1500 वैश्विक प्रतिभागियों के संवाद डेटा और प्राथमिकताएँ शामिल हैं, जो बड़े भाषा मॉडल में सुधार के लिए, जिससे मॉडल के संवाद विविधता, प्राथमिकता विविधता और सामाजिक लाभ में सुधार हो सके।

यह डेटा सेट प्रत्येक व्यक्ति की प्राथमिकताओं और सूक्ष्म प्रतिक्रिया को 21 विभिन्न LLM के 8,011 वास्तविक समय के संवादों में मैप करता है।

डेटा सेट प्रवेश:https://huggingface.co/datasets/HannahRoseKirk/prism-alignment

“DIG In” मापदंड

पाठ निर्माण छवि मॉडल में मौजूद भौगोलिक भिन्नताओं का मूल्यांकन करने के लिए, मॉडल सुधार के लिए अधिक संदर्भ डेटा प्रदान करता है। विभिन्न क्षेत्रों के लोगों के भौगोलिक प्रतिनिधित्व के बारे में दृष्टिकोण को समझने के लिए, Meta ने एक बड़े पैमाने पर एनोटेशन अध्ययन किया। हमने प्रत्येक उदाहरण के लिए 65,000 से अधिक टिप्पणियाँ और 20 से अधिक सर्वेक्षण प्रतिक्रियाएँ एकत्र की हैं, जो आकर्षण, समानता, स्थिरता और साझा सुझावों को शामिल करती हैं, ताकि पाठ से छवि मॉडल के स्वचालित और मानव मूल्यांकन में सुधार किया जा सके।

कोड प्रवेश:https://top.aibase.com/tool/dig-in

इन परियोजनाओं का विमोचन AI क्षेत्र में नए तकनीकी नवाचारों और अनुप्रयोग संभावनाओं का परिचय देता है, जो AI तकनीक के विकास और अनुप्रयोग को आगे बढ़ाने में महत्वपूर्ण है।