A Hugging Face lançou um impressionante modelo de IA chamado SmolVLM. Este modelo de linguagem visual é tão pequeno que pode ser executado em dispositivos menores, como smartphones, e supera o desempenho de modelos anteriores que exigem grandes centros de dados.

O modelo SmolVLM-256M requer menos de 1 GB de memória GPU, mas seu desempenho supera o de seu antecessor, Idefics80B, que é 300 vezes maior, representando um grande avanço na implantação de IA prática.

De acordo com Andrés Marlafeoti, engenheiro de pesquisa de aprendizado de máquina da Hugging Face, o modelo SmolVLM, além de ser lançado no mercado, proporciona uma redução significativa nos custos computacionais para as empresas. "Nosso Idefics80B, lançado em agosto de 2023, foi o primeiro modelo de linguagem visual de código aberto, e o SmolVLM representa uma redução de tamanho de 300 vezes, com aumento de desempenho", disse Marlafeoti em entrevista ao Jornal do Empreendedor.

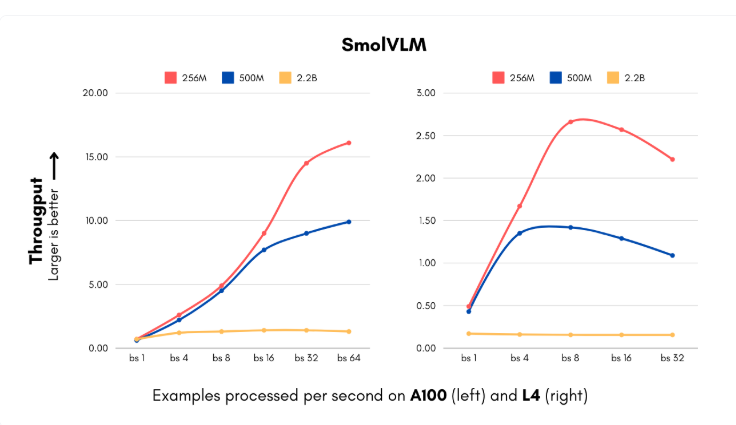

O lançamento do modelo SmolVLM ocorre em um momento crucial em que as empresas enfrentam altos custos computacionais na implementação de sistemas de inteligência artificial. O novo modelo, disponível em dois tamanhos (256M e 500M de parâmetros), pode processar imagens e compreender conteúdo visual em uma velocidade nunca antes vista. A versão menor pode processar até 16 instâncias por segundo, usando apenas 15 GB de memória, sendo ideal para empresas que precisam processar grandes quantidades de dados visuais. Para uma empresa de médio porte que processa 1 milhão de imagens por mês, isso significa uma economia significativa nos custos computacionais anuais.

Além disso, a IBM também colaborou com a Hugging Face, integrando o modelo de 256M ao seu software de processamento de documentos, Docling. Apesar de possuir amplos recursos computacionais, a IBM consegue processar milhões de documentos de forma eficiente e com menor custo usando um modelo menor.

A equipe da Hugging Face conseguiu reduzir o tamanho do modelo sem perder o desempenho por meio de inovações técnicas nos componentes de processamento visual e linguagem. Eles substituíram o codificador visual original de 400M de parâmetros por uma versão de 93M de parâmetros e implementaram uma técnica de compactação de tokens mais agressiva. Essas inovações permitem que pequenas empresas e startups lancem produtos complexos de visão computacional em pouco tempo, com custos de infraestrutura muito menores.

O conjunto de dados de treinamento do SmolVLM contém 170 milhões de exemplos de treinamento, quase metade dos quais são usados para processamento de documentos e anotação de imagens. Esses avanços não apenas reduzem os custos, mas também abrem novas possibilidades de aplicação para as empresas, elevando sua capacidade de busca visual a um nível sem precedentes.

Este avanço da Hugging Face desafia a visão tradicional sobre a relação entre o tamanho do modelo e sua capacidade. O SmolVLM prova que arquiteturas pequenas e eficientes também podem apresentar um desempenho excelente. O futuro do desenvolvimento da IA pode não ser mais a busca por modelos maiores, mas sim por sistemas mais flexíveis e eficientes.

Modelo: https://huggingface.co/blog/smolervlm

Destaques:

🌟 O modelo SmolVLM da Hugging Face pode ser executado em smartphones e supera o desempenho do modelo Idefics80B, 300 vezes maior.

💰 O modelo SmolVLM ajuda as empresas a reduzir significativamente os custos computacionais, com uma velocidade de processamento de 16 instâncias por segundo.

🚀 As inovações tecnológicas deste modelo permitem que pequenas empresas e startups lancem produtos complexos de visão computacional em pouco tempo.