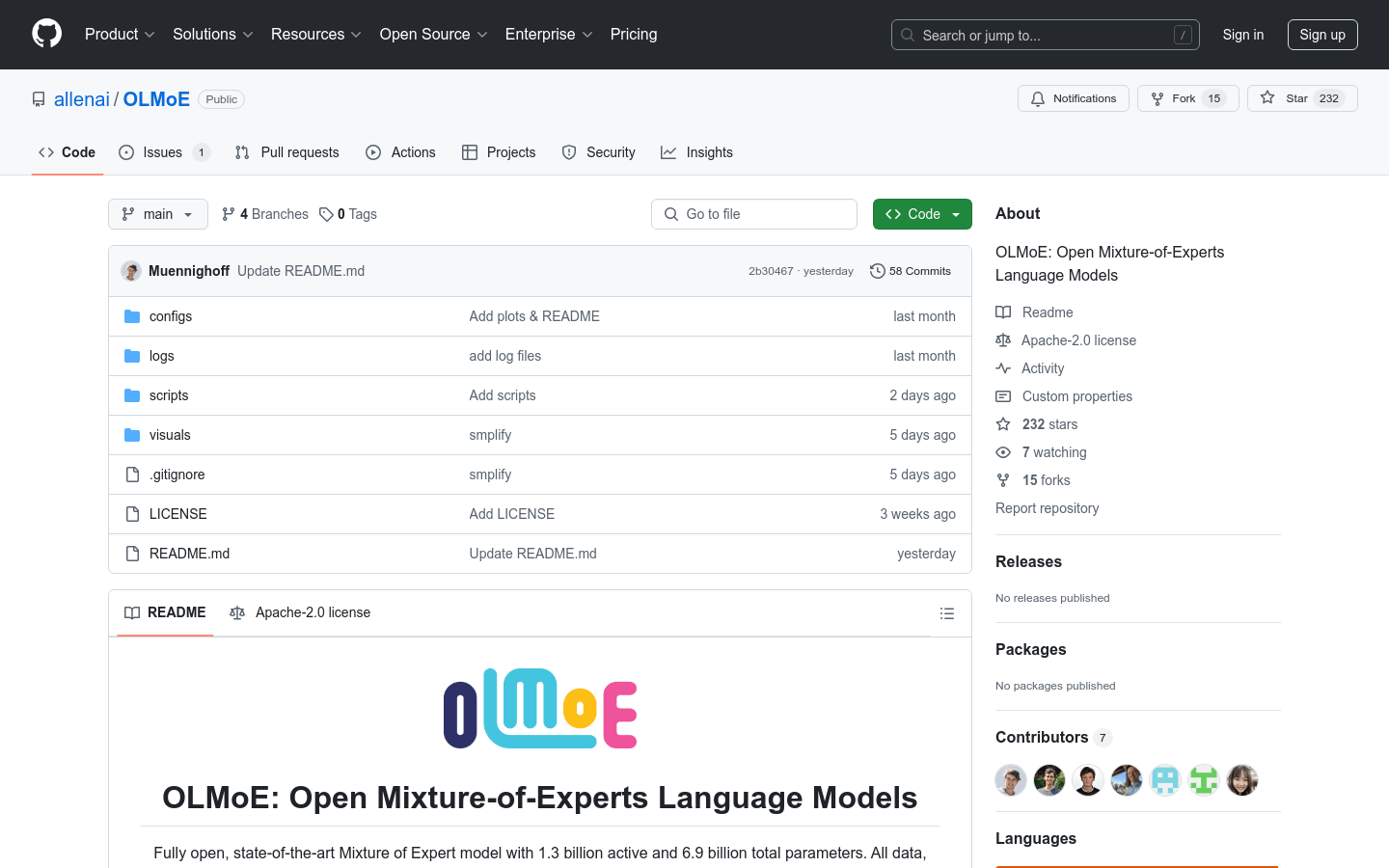

OLMoE

开源的专家混合语言模型,具有1.3亿活跃参数。

普通产品生产力自然语言处理专家混合模型

OLMoE是一个完全开放的、最先进的专家混合模型,具有1.3亿活跃参数和6.9亿总参数。该模型的所有数据、代码和日志都已发布。它提供了论文'OLMoE: Open Mixture-of-Experts Language Models'的所有资源概览。该模型在预训练、微调、适应和评估方面都具有重要应用,是自然语言处理领域的一个里程碑。

OLMoE 最新流量情况

月总访问量

502571820

跳出率

37.10%

平均页面访问数

5.9

平均访问时长

00:06:29