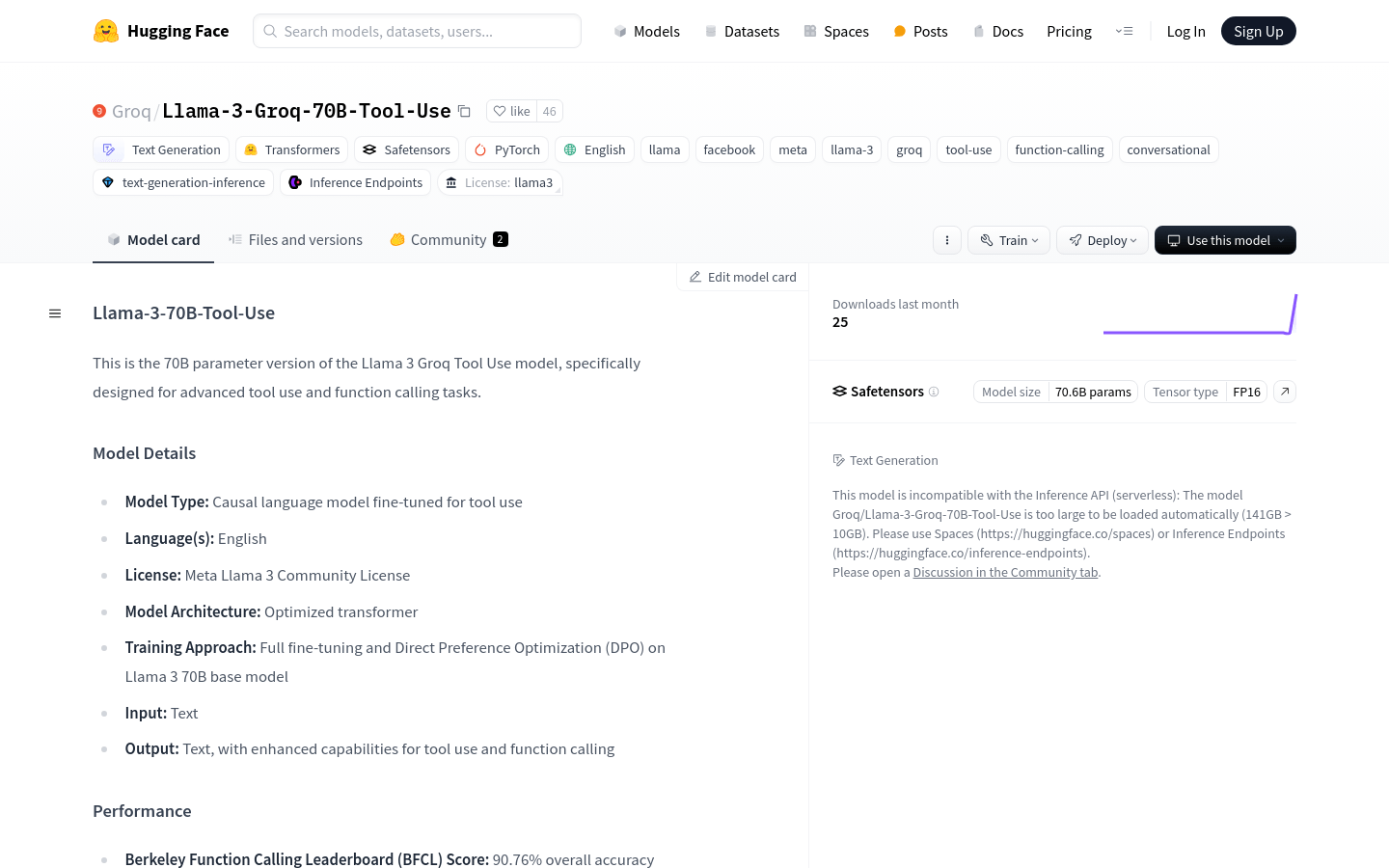

Llama-3-70B-Tool-Use

Großes Sprachmodell mit 70 Milliarden Parametern, optimiert für die Werkzeugnutzung

Normales ProduktProgrammierungGroßes SprachmodellWerkzeugnutzung

Llama-3-70B-Tool-Use ist ein großes Sprachmodell mit 70 Milliarden Parametern, das speziell für fortgeschrittene Werkzeugnutzung und Funktionsaufruffaufgaben entwickelt wurde. Das Modell erreicht eine Gesamtgenauigkeit von 90,76 % im Berkeley Functional Call Leaderboard (BFCL) und übertrifft damit alle Open-Source-Sprachmodelle mit 70 Milliarden Parametern. Das Modell optimiert die Transformer-Architektur und wurde durch vollständiges Fine-Tuning und direkte Präferenzoptimierung (DPO) auf der Basis des Llama 3 70B-Basismodells trainiert. Die Eingabe besteht aus Text, die Ausgabe ebenfalls aus Text, wobei die Fähigkeiten zur Werkzeugnutzung und Funktionsaufrufe verbessert wurden. Obwohl seine Hauptanwendung die Werkzeugnutzung und Funktionsaufrufe sind, können für allgemeine Wissensfragen oder offene Aufgaben eher universelle Sprachmodelle besser geeignet sein. Das Modell kann in einigen Fällen ungenaue oder voreingenommene Inhalte erzeugen. Benutzer sollten geeignete Sicherheitsmaßnahmen implementieren, um ihren spezifischen Anwendungsfall zu berücksichtigen. Das Modell reagiert sehr sensibel auf die Konfiguration von Temperatur und Top-p-Sampling.

Llama-3-70B-Tool-Use Neueste Verkehrssituation

Monatliche Gesamtbesuche

29742941

Absprungrate

44.20%

Durchschnittliche Seiten pro Besuch

5.9

Durchschnittliche Besuchsdauer

00:04:44

![Llama-3[8B] Meditron V1.0](https://pic.chinaz.com/ai/logo/2024/0430/30029.jpg)