ShieldGemma

Sicherheitsmodell zur Inhaltsprüfung

Normales ProduktProgrammierungInhaltsprüfungTextgenerierung

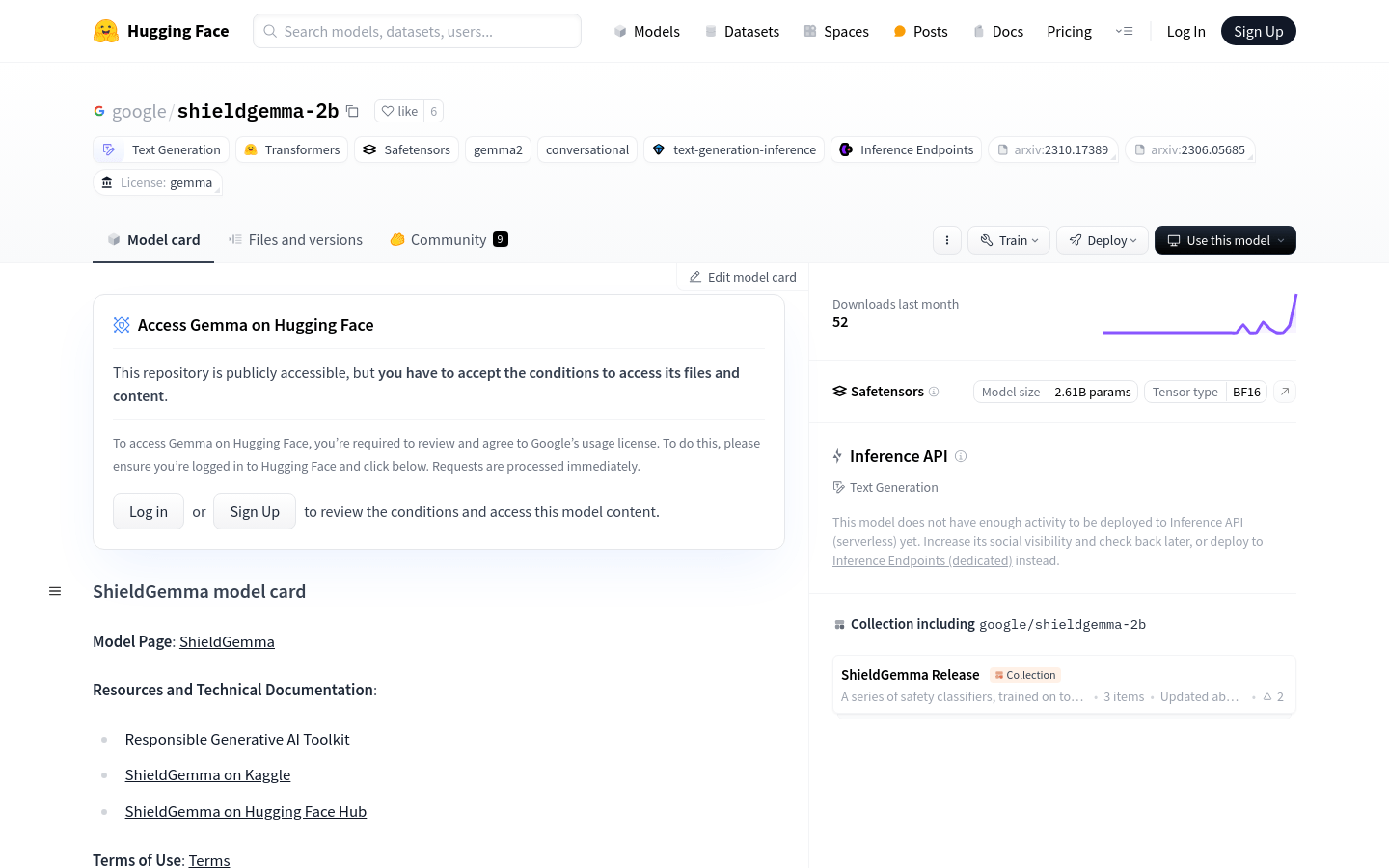

ShieldGemma ist eine von Google entwickelte Reihe von Sicherheitsmodellen zur Inhaltsprüfung, die auf Gemma 2 basieren und sich auf vier Gefährdungskategorien konzentrieren (kinderunfreundliche Inhalte, gefährliche Inhalte, Hassrede und Belästigung). Es handelt sich um rein textbasierte Decoder-Large-Language-Modelle, die ausschließlich auf Englisch verfügbar sind, Open-Source-Gewichte besitzen und in Größen von 2B, 9B und 27B Parametern vorliegen. Diese Modelle sollen als Teil eines verantwortungsvollen KI-Toolkits die Sicherheit von KI-Anwendungen verbessern.

ShieldGemma Neueste Verkehrssituation

Monatliche Gesamtbesuche

29742941

Absprungrate

44.20%

Durchschnittliche Seiten pro Besuch

5.9

Durchschnittliche Besuchsdauer

00:04:44