2025-03-13 14:13:03.AIbase.

Luma mejora la eficiencia de muestreo de su técnica de preentrenamiento de modelos de imagen IMM en 10 veces

2025-03-13 11:43:55.AIbase.

LuChen Technology lanza el nuevo modelo de video de código abierto Open-Sora 2.0 con proceso de entrenamiento completamente de código abierto

2025-03-12 15:16:41.AIbase.

Luma AI acelera la generación de imágenes diez veces con su tecnología de preentrenamiento IMM de código abierto

2025-03-12 10:23:07.AIbase.

Meta empieza a probar un chip propio para entrenar IA, reduciendo la dependencia de Nvidia

2025-03-12 09:11:37.AIbase.

Meta prueba un chip de IA de entrenamiento interno para reducir la dependencia de Nvidia

2025-03-07 16:19:22.AIbase.

¡Sin entrenamiento! Q-Filters permite una compresión eficiente de la caché KV y mejora el rendimiento de la inferencia

2025-03-05 09:13:04.AIbase.

Vivo reorganiza y crea nuevo departamento de IA, trasladando el entrenamiento de modelos grandes al lado del cliente

2025-02-27 10:45:10.AIbase.

DeepSeek lanza la actualización de estrategia paralela en su cuarto día de código abierto: DualPipe y EPLB impulsan la revolución del entrenamiento de modelos grandes

2025-02-26 10:21:59.AIbase.

Anthropic afirma que el entrenamiento del soneto Claude 3.7 costó decenas de millones de dólares, mucho menos que algunos competidores

2025-02-26 09:33:45.AIbase.

DeepSeek Semana Abierta de código abierto, Día 3: Lanzamiento de DeepGEMM, biblioteca FP8 GEMM para entrenamiento e inferencia de IA

2025-02-25 09:13:07.AIbase.

1000 artistas lanzan un álbum 'silencioso' para protestar contra la venta de derechos de autor a la IA por parte del Reino Unido

2025-02-24 09:39:37.AIbase.

OctoTools: El nuevo marco de IA de Stanford permite una inferencia compleja y eficiente sin necesidad de entrenamiento

2025-02-24 09:25:15.AIbase.

Moonlight y UCLA presentan un nuevo modelo Mixture-of-Expert para mejorar la eficiencia del entrenamiento de modelos de lenguaje

2025-02-19 08:33:46.AIbase.

DeepSeek presenta la tecnología NSA: Acelera el entrenamiento y la inferencia de contextos largos

2025-02-18 16:21:37.AIbase.

Musk revela el costo de entrenamiento de Grok 3: 200,000 GPU de Nvidia

2025-02-17 10:22:56.AIbase.

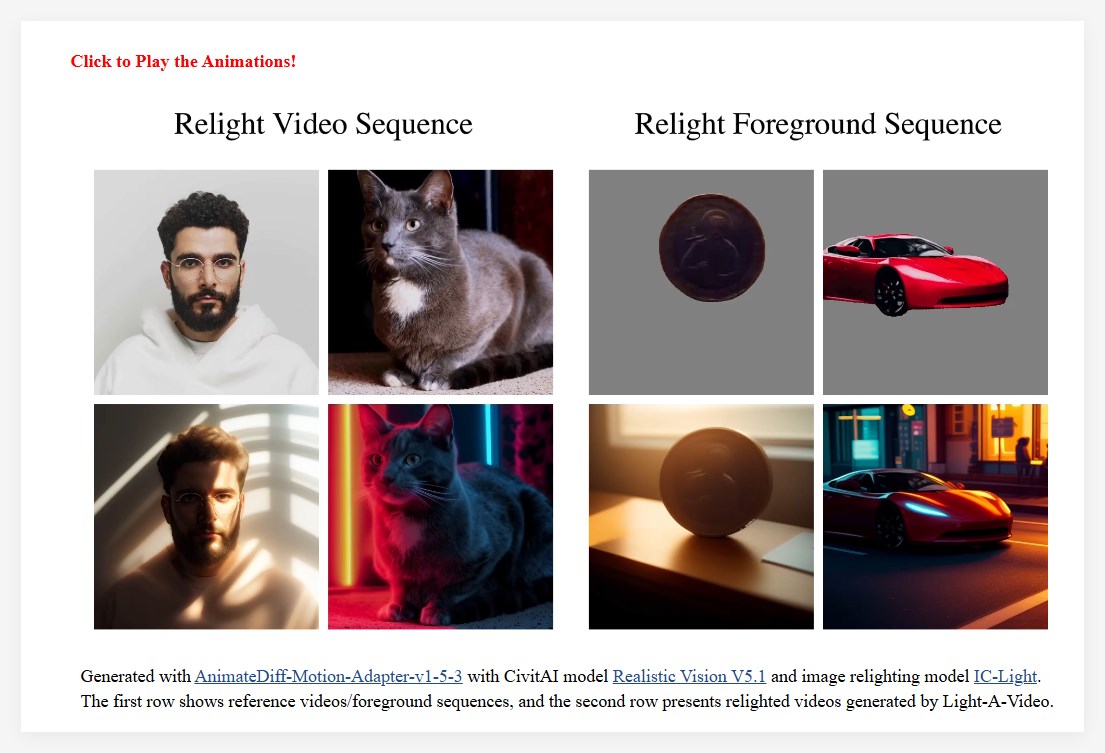

Light-A-Video: Reiluminación de vídeo sin necesidad de entrenamiento

2025-02-17 10:05:18.AIbase.

Meta innova con el marco "mezcla de conceptos continuos", impulsando una nueva revolución en el preentrenamiento de transformadores

2025-02-12 08:43:18.AIbase.

Li Yanhong sobre el entrenamiento de la próxima generación de grandes modelos: el enfoque actual debe estar en el progreso tecnológico y la reducción de costos

2025-02-10 11:04:17.AIbase.

Meta AI presenta MILS: un sistema que permite a los LLMs procesar datos multimedia sin entrenamiento específico

2025-02-10 10:31:26.AIbase.