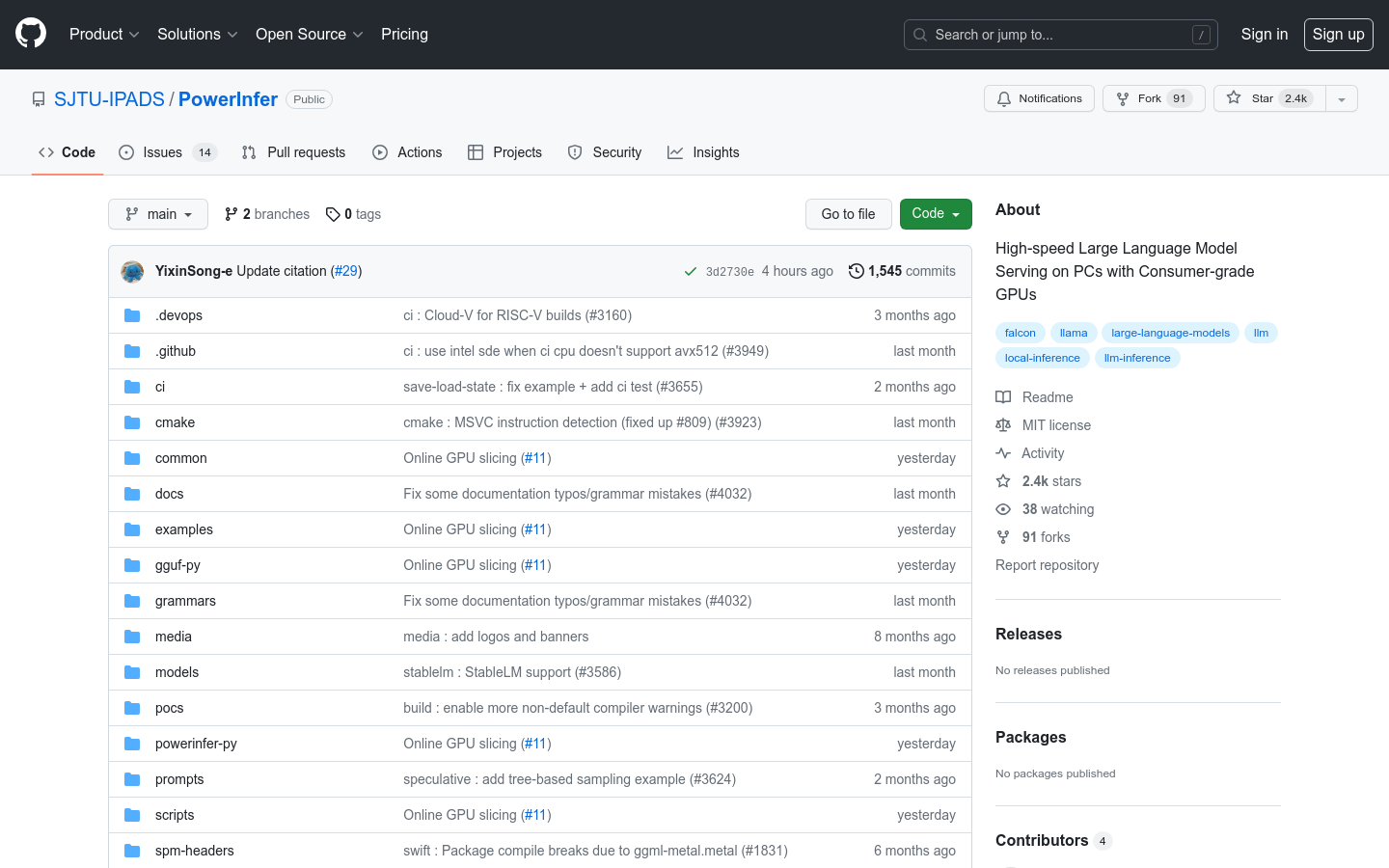

PowerInfer

Motor de inferencia de modelos lingüísticos grandes de alta velocidad para implementación local

Producto ComúnProductividadModelo lingüísticoMotor de inferencia

PowerInfer es un motor que permite la inferencia de modelos lingüísticos grandes a alta velocidad en computadoras personales utilizando GPUs de consumo. Aprovecha las características de alta localidad en la inferencia de LLM, precargando neuronas activadas en la GPU para reducir significativamente la demanda de memoria de la GPU y la transferencia de datos CPU-GPU. PowerInfer también integra un predictor adaptativo y operadores de cálculo disperso con consciencia neuronal para optimizar la eficiencia de la activación neuronal y la dispersión del cálculo. Puede realizar inferencias en una sola GPU NVIDIA RTX 4090 a una velocidad de generación promedio de 13.20 tokens por segundo, solo un 18% más lento que las GPUs A100 de nivel servidor de gama alta, manteniendo al mismo tiempo la precisión del modelo.

PowerInfer Situación del tráfico más reciente

Total de visitas mensuales

474564576

Tasa de rebote

36.20%

Páginas promedio por visita

6.1

Duración promedio de la visita

00:06:34