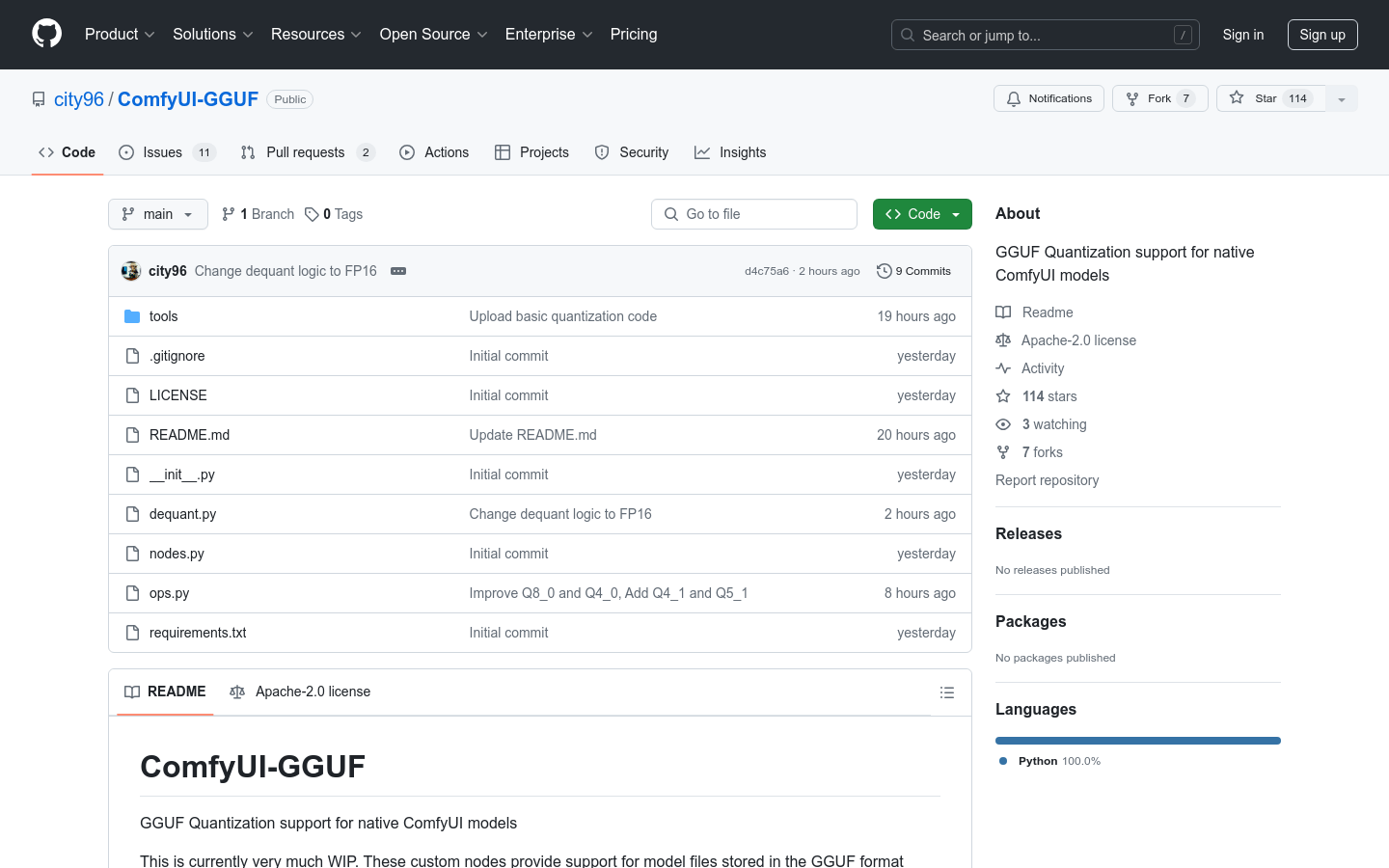

ComfyUI-GGUF

Prise en charge de la quantification GGUF, optimisation des performances des modèles natifs ComfyUI

Produit OrdinaireProgrammationGGUFQuantification

ComfyUI-GGUF est un projet qui fournit une prise en charge de la quantification GGUF pour les modèles natifs de ComfyUI. Il permet aux fichiers de modèles d'être stockés au format GGUF, un format promu par llama.cpp. Bien que les modèles UNET conventionnels (conv2d) ne soient pas adaptés à la quantification, les modèles transformer/DiT comme flux semblent moins affectés. Cela permet leur exécution sur des GPU bas de gamme avec un débit binaire par poids plus faible.

ComfyUI-GGUF Dernière situation du trafic

Nombre total de visites mensuelles

474564576

Taux de rebond

36.20%

Nombre moyen de pages par visite

6.1

Durée moyenne de la visite

00:06:34