A Adobe, um nome respeitado na indústria criativa, conhecida como "guardiã dos direitos autorais" por sua postura em relação à proteção de direitos autorais, recentemente se viu envolvida em uma controvérsia devido a uma atualização discreta de seus termos de serviço.

Em fevereiro deste ano, a Adobe atualizou silenciosamente os termos de serviço de seus produtos, adicionando uma cláusula notável: os usuários devem concordar que a Adobe pode acessar suas obras de forma automática e manual, incluindo aquelas protegidas por acordos de confidencialidade. A Adobe usará essas obras para melhorar seus serviços e softwares por meio de tecnologias como aprendizado de máquina. Se os usuários não concordarem com esses novos termos, não poderão usar o software da Adobe.

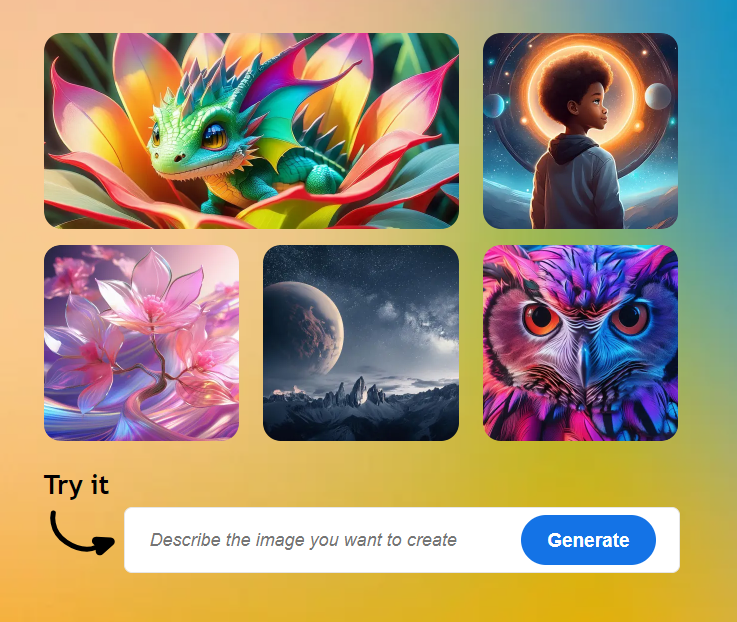

Essa mudança, recentemente exposta, gerou forte resistência entre os principais usuários da Adobe, como profissionais criativos, artistas digitais e designers. Eles consideram isso uma autorização forçada, essencialmente uma "cláusula abusiva", cujo objetivo real é treinar o modelo de IA generativa da Adobe, "Firefly". Um blogueiro chamado Sam Santala questionou essa cláusula no Twitter, e sua publicação alcançou milhões de visualizações.

Muitos usuários expressaram suas preocupações sobre privacidade e direitos autorais, optando por parar de usar os produtos da Adobe. Simultaneamente, a Meta adotou medidas semelhantes, atualizando sua política de privacidade para permitir o uso de informações compartilhadas pelos usuários em produtos e serviços da Meta para treinar IA. Se os usuários não concordarem com a nova política de privacidade, devem considerar parar de usar plataformas de mídia social como Facebook e Instagram.

Com o rápido desenvolvimento da tecnologia de IA, a luta entre empresas de tecnologia e usuários sobre privacidade de dados, propriedade e controle de conteúdo está se tornando cada vez mais intensa. A Adobe afirma que os dados de treinamento de seu modelo Firefly são provenientes de centenas de milhões de imagens de sua biblioteca de imagens, algumas imagens com licenças abertas e imagens de domínio público com direitos autorais expirados. No entanto, outras ferramentas de geração de imagens de IA, como Stable Diffusion da Stability AI, Dall-E 2 da OpenAI e Midjourney, já foram alvo de controvérsias sobre direitos autorais.

A Adobe tenta se diferenciar nesse mercado, buscando ser o "cavaleiro branco" na corrida armamentista da IA, enfatizando a legitimidade dos dados de treinamento de seu modelo e prometendo indenizar por disputas de direitos autorais decorrentes do uso de imagens geradas pelo Adobe Firefly. Mas essa estratégia não acalmou todas as preocupações dos usuários. Alguns usuários, como o designer experiente Ajê, brincam que são "vítimas do software original da Adobe", acreditando que a Adobe usa seu vasto ecossistema criativo para treinar IA, o que, embora seja uma estratégia comercial inteligente, ignora a distribuição de lucros entre a plataforma e os criadores e a falta de transparência para o usuário.

Além disso, disputas de direitos autorais relacionadas à Adobe têm surgido no exterior, levantando dúvidas sobre se a Adobe realmente respeita os direitos autorais dos criadores. Por exemplo, o artista Brian Kesinger descobriu que imagens geradas por IA, semelhantes ao seu estilo, estavam sendo vendidas em nome dele na biblioteca de imagens da Adobe sem sua permissão. Os administradores do espólio do fotógrafo Ansel Adams também acusaram publicamente a Adobe de vender imitações de IA das obras do falecido fotógrafo.

Sob pressão da opinião pública, a Adobe revisou seus termos de serviço em 19 de junho, declarando explicitamente que não usará o conteúdo armazenado localmente ou na nuvem pelos usuários para treinar modelos de IA. Mas essa declaração não acalmou completamente as preocupações dos criadores. Alguns blogueiros conhecidos do setor de IA no exterior apontaram que a versão revisada dos termos de serviço da Adobe ainda permite o uso de dados privados na nuvem para treinar modelos de aprendizado de máquina de ferramentas de IA não generativas. Embora os usuários possam optar por sair da "análise de conteúdo", o processo de cancelamento complexo desanima muitos usuários.

As leis de proteção de dados do usuário variam de país para país, influenciando as estratégias das plataformas de mídia social ao definir seus termos de serviço. Por exemplo, sob o Regulamento Geral de Proteção de Dados (GDPR), usuários no Reino Unido e na UE têm o "direito de oposição", podendo optar explicitamente por não ter seus dados pessoais usados para treinar modelos de IA da Meta. No entanto, os usuários americanos não têm o mesmo direito de informação; de acordo com a política de compartilhamento de dados atual da Meta, o conteúdo postado pelos usuários americanos em plataformas de mídia social da Meta pode ter sido usado para treinar IA sem consentimento explícito.

Os dados são considerados o "novo petróleo" da era da IA, mas a "extração" desses recursos ainda apresenta muitas áreas cinzentas. Algumas empresas de tecnologia têm adotado abordagens ambíguas na obtenção de dados do usuário, o que gera um duplo dilema para os direitos de informação pessoal dos usuários: direitos autorais digitais e privacidade de dados, prejudicando seriamente a confiança dos usuários nas plataformas.

Atualmente, as plataformas ainda apresentam grandes deficiências em garantir que a IA generativa não viole os direitos dos criadores, e faltam regulamentações adequadas. Alguns desenvolvedores e criadores já estão tomando medidas, lançando uma série de ferramentas "anti-IA", desde a ferramenta de proteção de obras Glaze e a ferramenta de envenenamento de dados de IA Nightshade até a popularização da comunidade anti-IA Cara. Diante da coleta de dados por empresas de tecnologia para treinar modelos de IA sem o consentimento do usuário/criador, a indignação está crescendo.

No rápido desenvolvimento da tecnologia de IA, o equilíbrio entre inovação tecnológica e segurança da privacidade do usuário, garantindo os direitos dos criadores, ainda requer maior desenvolvimento do setor e aprimoramento contínuo das medidas de regulamentação legal. Ao mesmo tempo, os usuários precisam ser mais vigilantes, entender seus direitos de dados e tomar medidas para proteger suas criações e privacidade quando necessário.