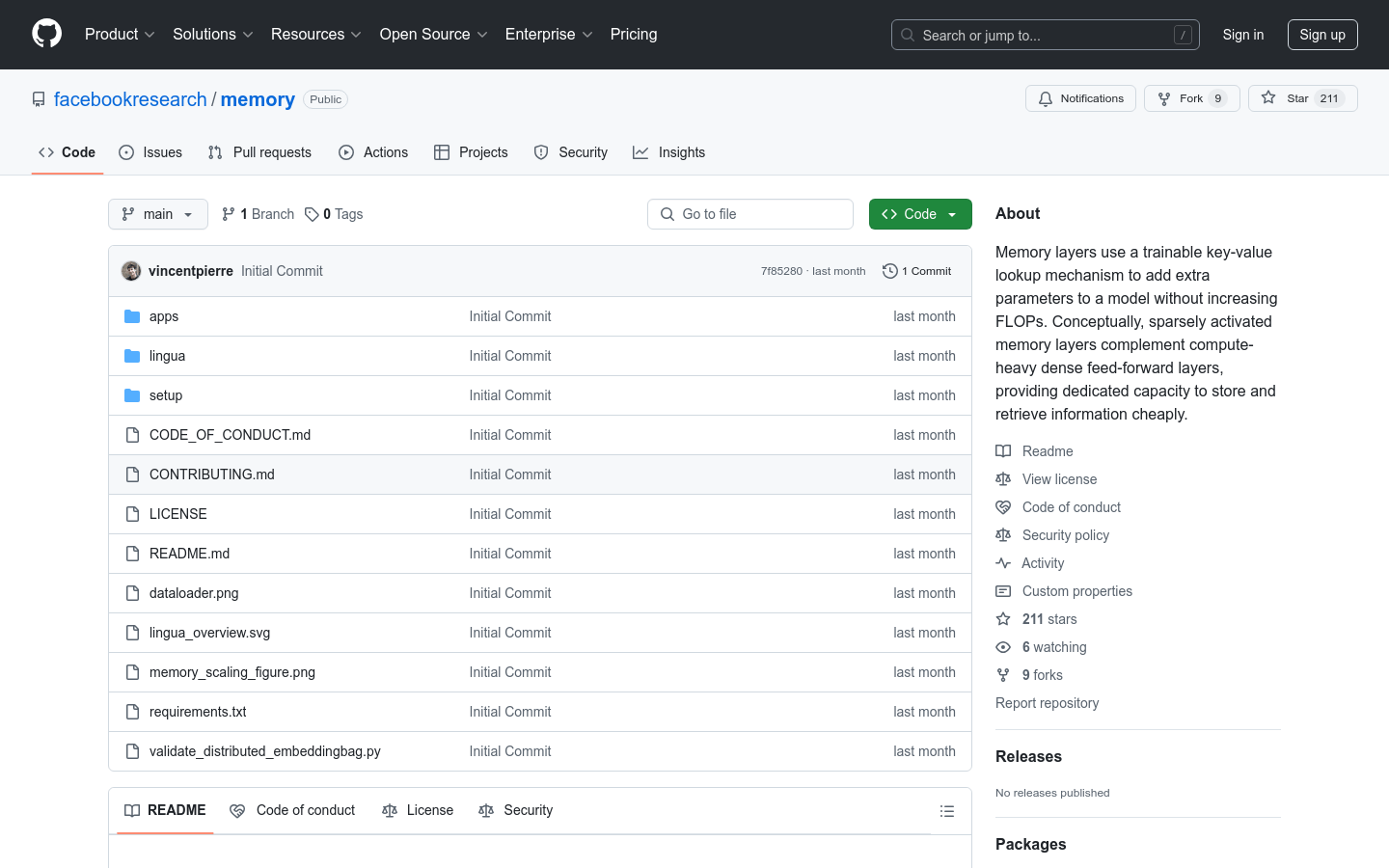

Memory

Eine skalierbare Implementierung einer Memory-Layer, die die Modellparameter erweitert, ohne den Rechenaufwand zu erhöhen.

Normales ProduktProgrammierungMemory-LayerModellskalierung

Memory Layers at Scale ist eine innovative Implementierung einer Memory-Layer, die durch einen trainierbaren Key-Value-Suchmechanismus zusätzliche Parameter zum Modell hinzufügt, ohne die Anzahl der Gleitkommaoperationen zu erhöhen. Diese Methode ist besonders wichtig bei großen Sprachmodellen, da sie die Speicher- und Abrufleistung des Modells deutlich verbessert, während die Rechenleistung erhalten bleibt. Zu den Hauptvorteilen dieser Technologie gehören die effiziente Skalierung der Modellkapazität, die Reduzierung des Verbrauchs an Rechenressourcen sowie die Verbesserung der Flexibilität und Skalierbarkeit des Modells. Das Projekt wurde vom Meta Lingua Team entwickelt und eignet sich für Szenarien, in denen große Datenmengen und komplexe Modelle verarbeitet werden müssen.

Memory Neueste Verkehrssituation

Monatliche Gesamtbesuche

474564576

Absprungrate

36.20%

Durchschnittliche Seiten pro Besuch

6.1

Durchschnittliche Besuchsdauer

00:06:34