Gemma-2B-10M

Modelo Gemma 2B, admite secuencias de hasta 10M de longitud, optimiza el uso de memoria y es adecuado para aplicaciones de modelos de lenguaje a gran escala.

Producto ComúnProgramaciónModelo de lenguajeMecanismo de atención

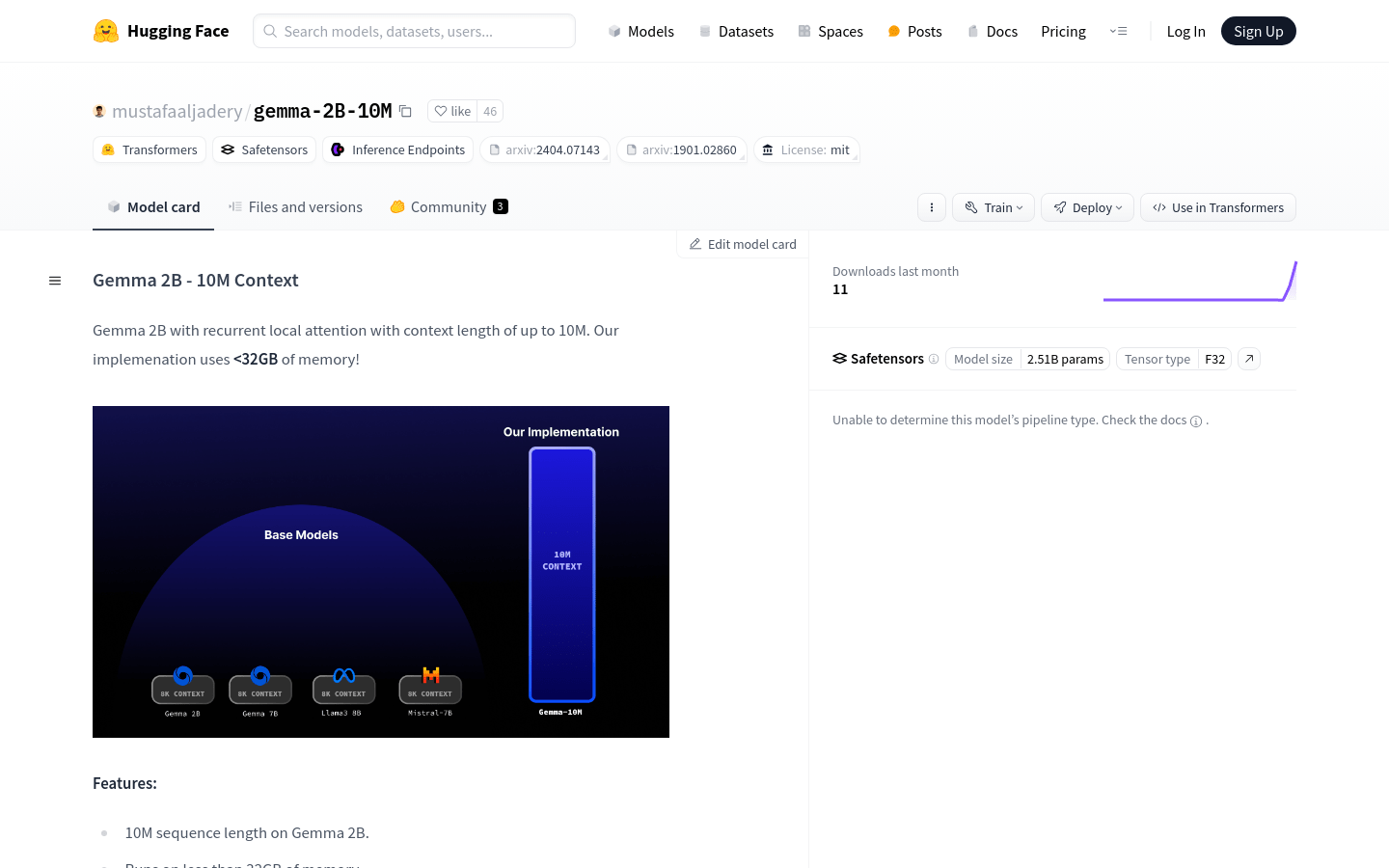

Gemma 2B - 10M Context es un modelo de lenguaje a gran escala que, gracias a la optimización de un innovador mecanismo de atención, puede procesar secuencias de hasta 10M de longitud con un uso de memoria inferior a 32 GB. Este modelo emplea una técnica de atención local recurrente, inspirada en el artículo Transformer-XL, constituyendo una potente herramienta para tareas de procesamiento de lenguaje a gran escala.

Gemma-2B-10M Situación del tráfico más reciente

Total de visitas mensuales

29742941

Tasa de rebote

44.20%

Páginas promedio por visita

5.9

Duración promedio de la visita

00:04:44