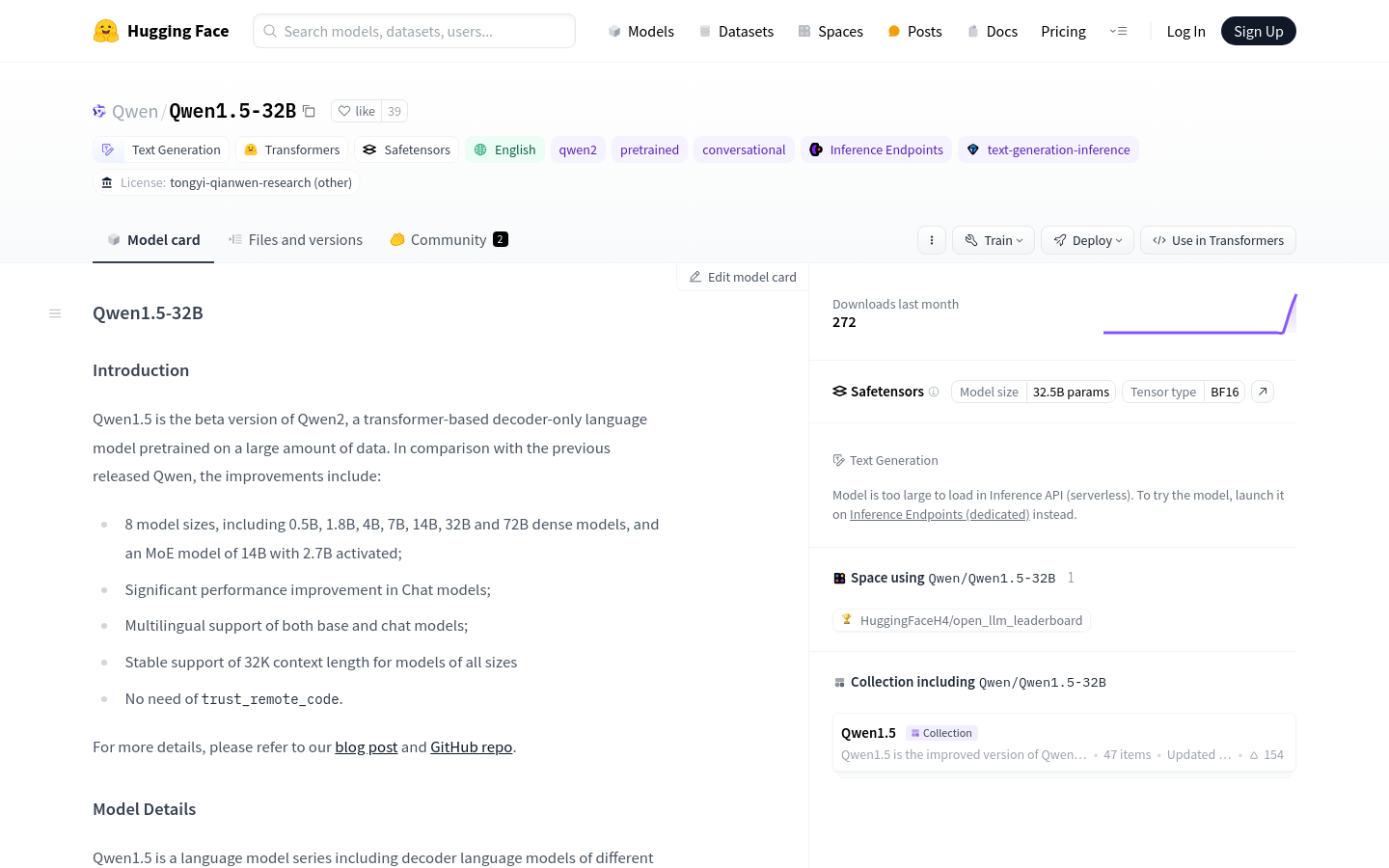

Qwen1.5-32B

Eine Serie von vorab trainierten Sprachmodellen basierend auf der Transformer-Architektur

Normales ProduktProduktivitätPretrainiertes ModellTransformer

Qwen1.5 ist eine Serie von Decoder-Sprachmodellen, die auf der Transformer-Architektur basieren und verschiedene Modellgrößen umfasst. Es zeichnet sich durch SwiGLU-Aktivierung, QKV-Bias in der Aufmerksamkeit und gruppierte Query-Aufmerksamkeit aus. Es unterstützt mehrere natürliche Sprachen und Code. Eine Weiterentwicklung durch Feinabstimmung (z.B. SFT, RLHF) wird empfohlen. Die Nutzung ist kostenlos.

Qwen1.5-32B Neueste Verkehrssituation

Monatliche Gesamtbesuche

29742941

Absprungrate

44.20%

Durchschnittliche Seiten pro Besuch

5.9

Durchschnittliche Besuchsdauer

00:04:44