RL4VLM

Feinabstimmung eines großen visuellen Sprachmodells mittels Verstärkungslernen als Entscheidungsagent

Normales ProduktProgrammierungVerstärkungslernenVisuell-Sprachmodell

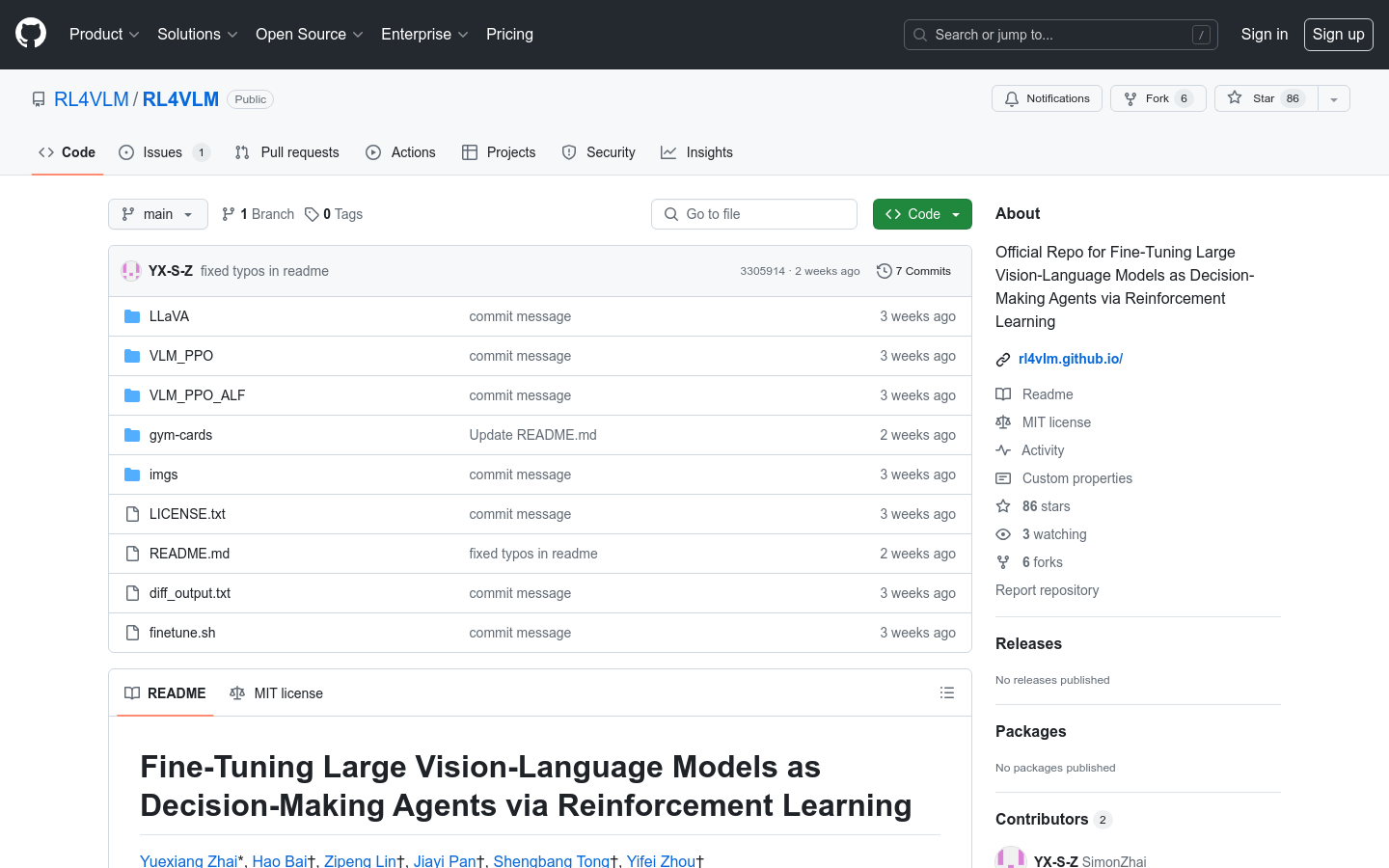

RL4VLM ist ein Open-Source-Projekt, das darauf abzielt, ein großes visuelles Sprachmodell durch Verstärkungslernen (Reinforcement Learning) zu feinabstimmen, um es zu einem intelligenten Agenten zu machen, der Entscheidungen treffen kann. Das Projekt wurde von den Forschern Yuexiang Zhai, Hao Bai, Zipeng Lin, Jiayi Pan, Shengbang Tong, Alane Suhr, Saining Xie, Yann LeCun, Yi Ma und Sergey Levine gemeinsam entwickelt. Es basiert auf dem LLaVA-Modell und verwendet den PPO-Algorithmus für die Feinabstimmung durch Verstärkungslernen. Das RL4VLM-Projekt bietet eine detaillierte Struktur des Code-Repositorys, eine Anleitung für den Einstieg, Informationen zur Lizenz und Hinweise zum Zitieren der Forschung.

RL4VLM Neueste Verkehrssituation

Monatliche Gesamtbesuche

474564576

Absprungrate

36.20%

Durchschnittliche Seiten pro Besuch

6.1

Durchschnittliche Besuchsdauer

00:06:34